HDFS用戶端操作(開發重點)

2020-08-12 16:31:00

參考尚硅谷hadoop公開課

HDFS用戶端環境準備

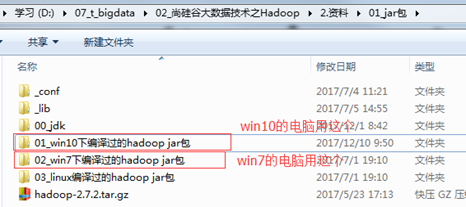

1.根據自己電腦的操作系統拷貝對應的編譯後的hadoop jar包到非中文路徑(例如:D:\hadoop\hadoop-2.7.2),如圖所示。

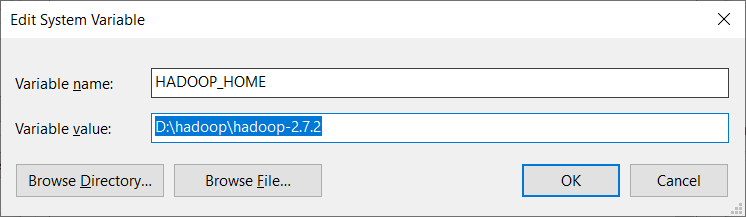

2.設定HADOOP_HOME環境變數,如圖所示。

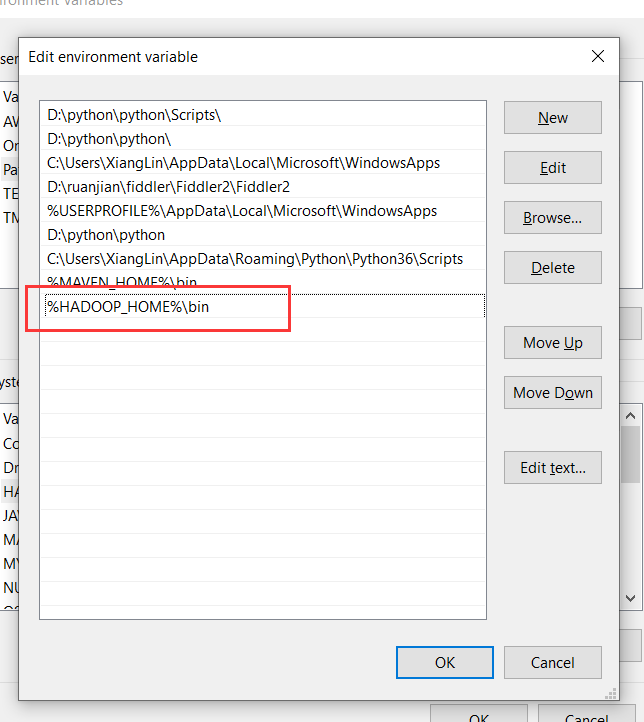

3. 設定Path環境變數,如圖3-6所示。

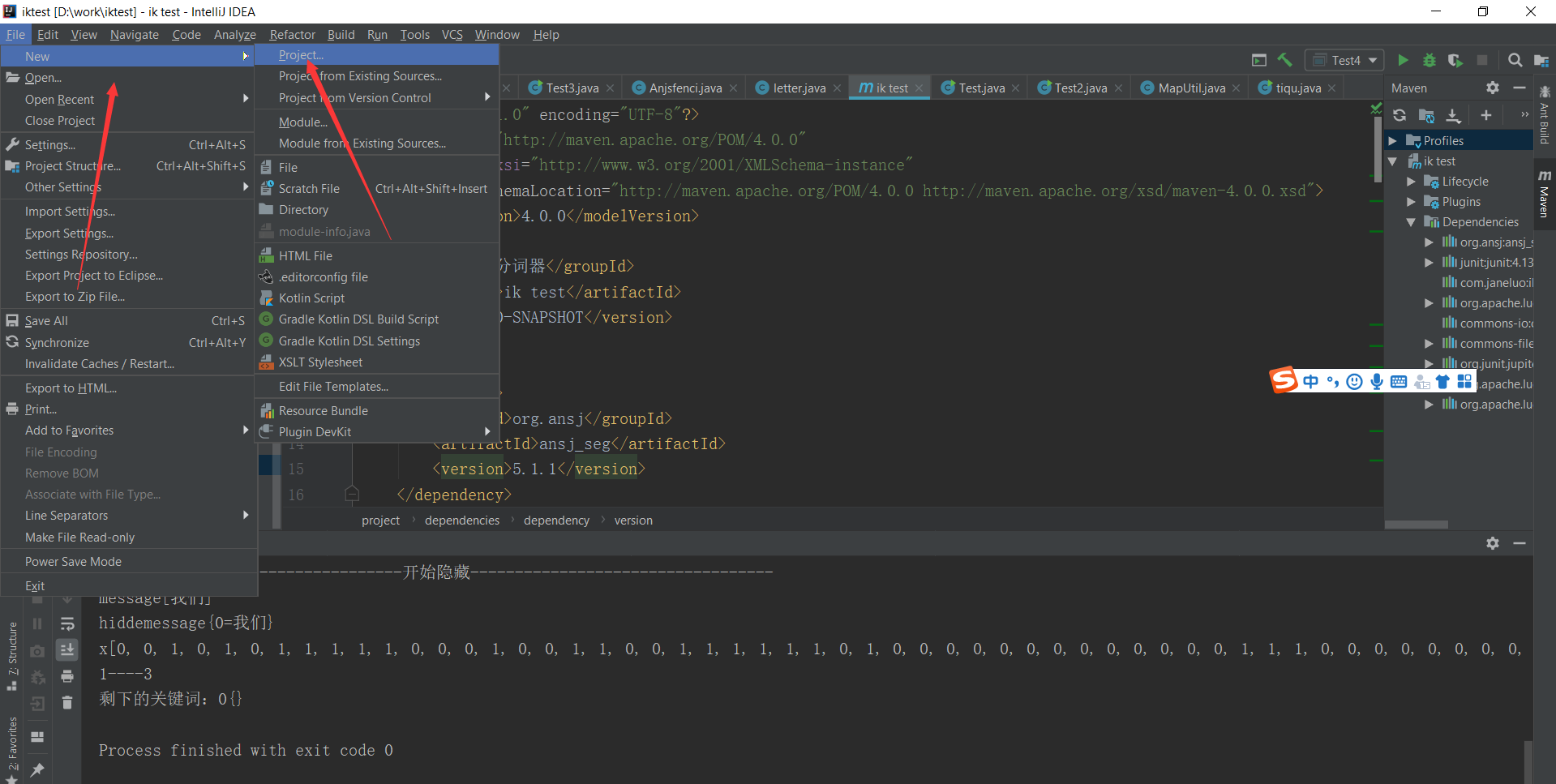

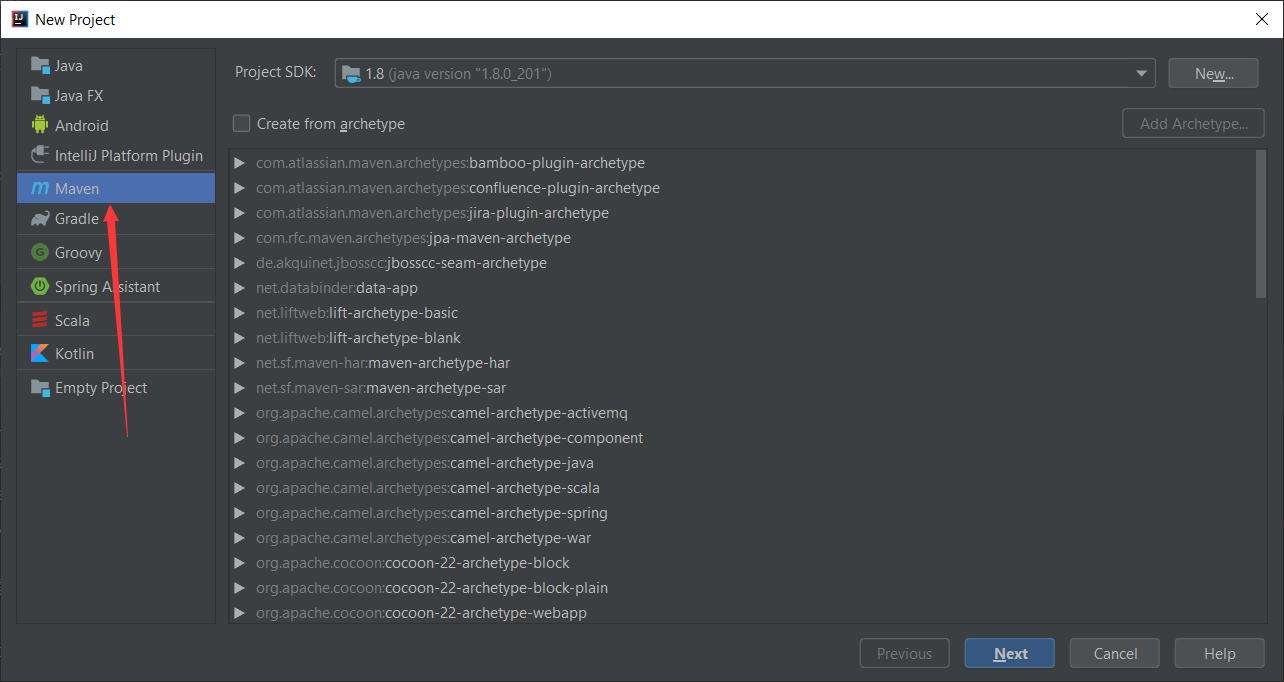

4.建立一個Maven工程HdfsClientDemo

1.

2.

3.

4.

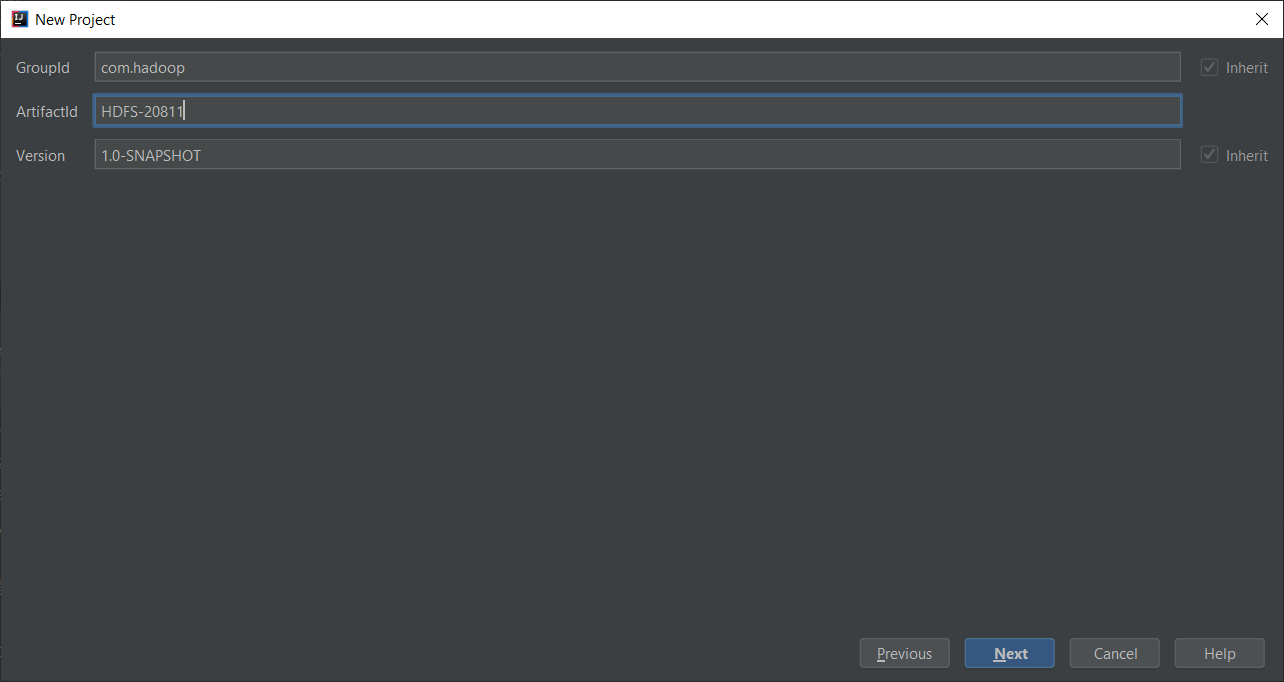

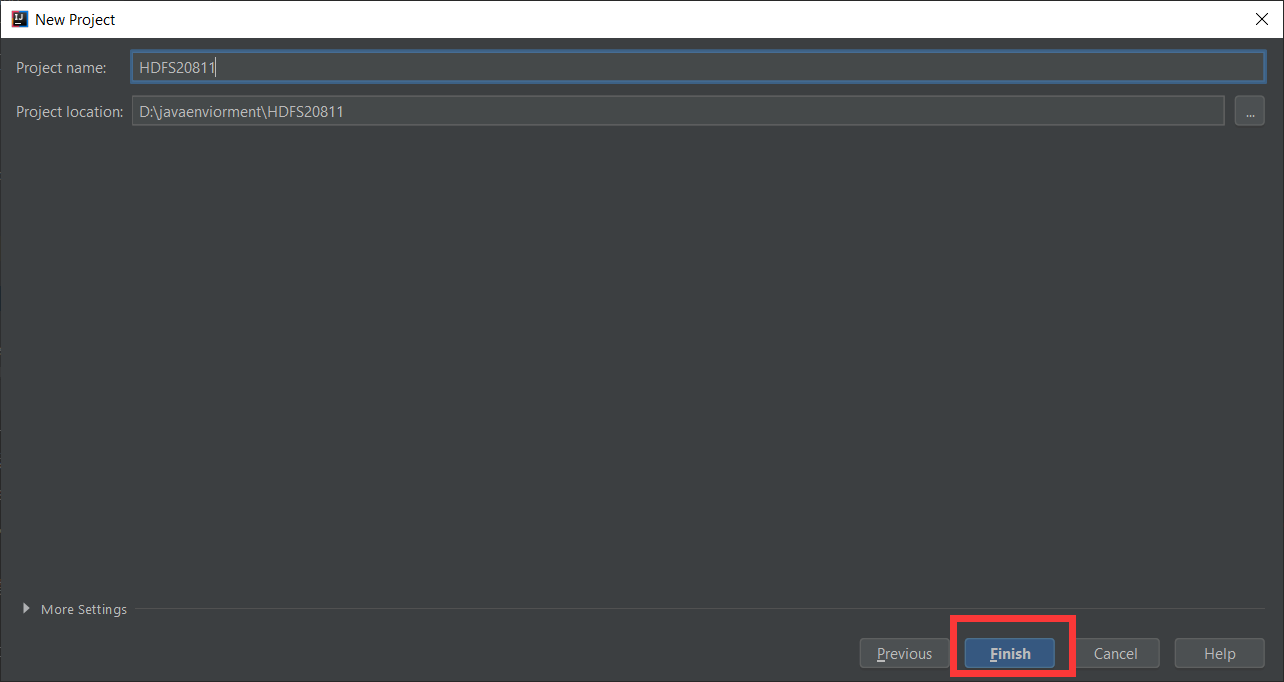

4.建立一個Maven工程Hdfs20811

5.匯入相應的依賴座標+日誌新增

<dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>RELEASE</version>

</dependency>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-core</artifactId>

<version>2.8.2</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.2</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.7.2</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>2.7.2</version>

</dependency>

<dependency>

<groupId>jdk.tools</groupId>

<artifactId>jdk.tools</artifactId>

<version>1.8</version>

<scope>system</scope>

<systemPath>${JAVA_HOME}/lib/tools.jar</systemPath>

</dependency>

</dependencies>

注意:如果Eclipse/Idea列印不出日誌,在控制檯上只顯示

1.log4j:WARN No appenders could be found for logger (org.apache.hadoop.util.Shell).

2.log4j:WARN Please initialize the log4j system properly.

3.log4j:WARN See http://logging.apache.org/log4j/1.2/faq.html#noconfig for more info.

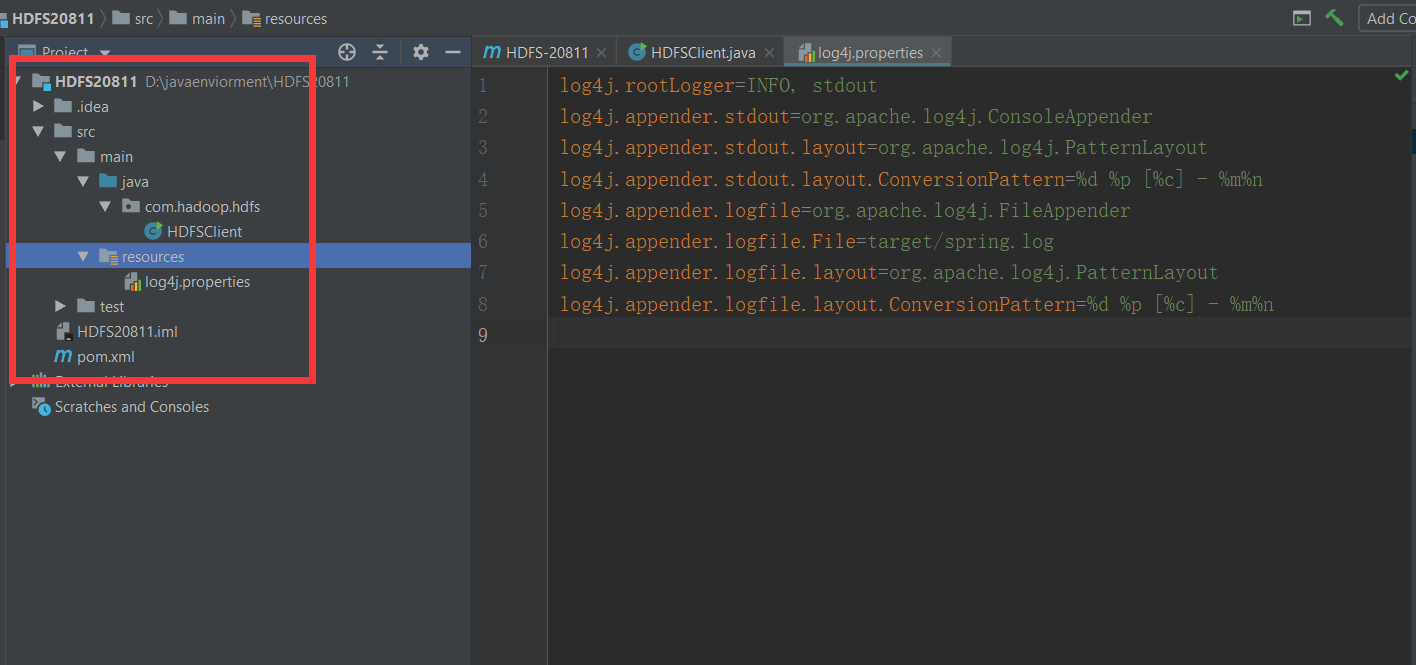

需要在專案的src/main/resources目錄下,新建一個檔案,命名爲「log4j.properties」,在檔案中填入

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

6.建立包名:com.hadoop.hdfs

7.建立HdfsClient類

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.IOException;

public class HDFSClient {

public static void main(String[] args) throws IOException {

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://192.168.88.102:9000");

//.獲取hdfs用戶端物件

FileSystem fs = FileSystem.get(conf);

//2.在hdfs上建立路徑

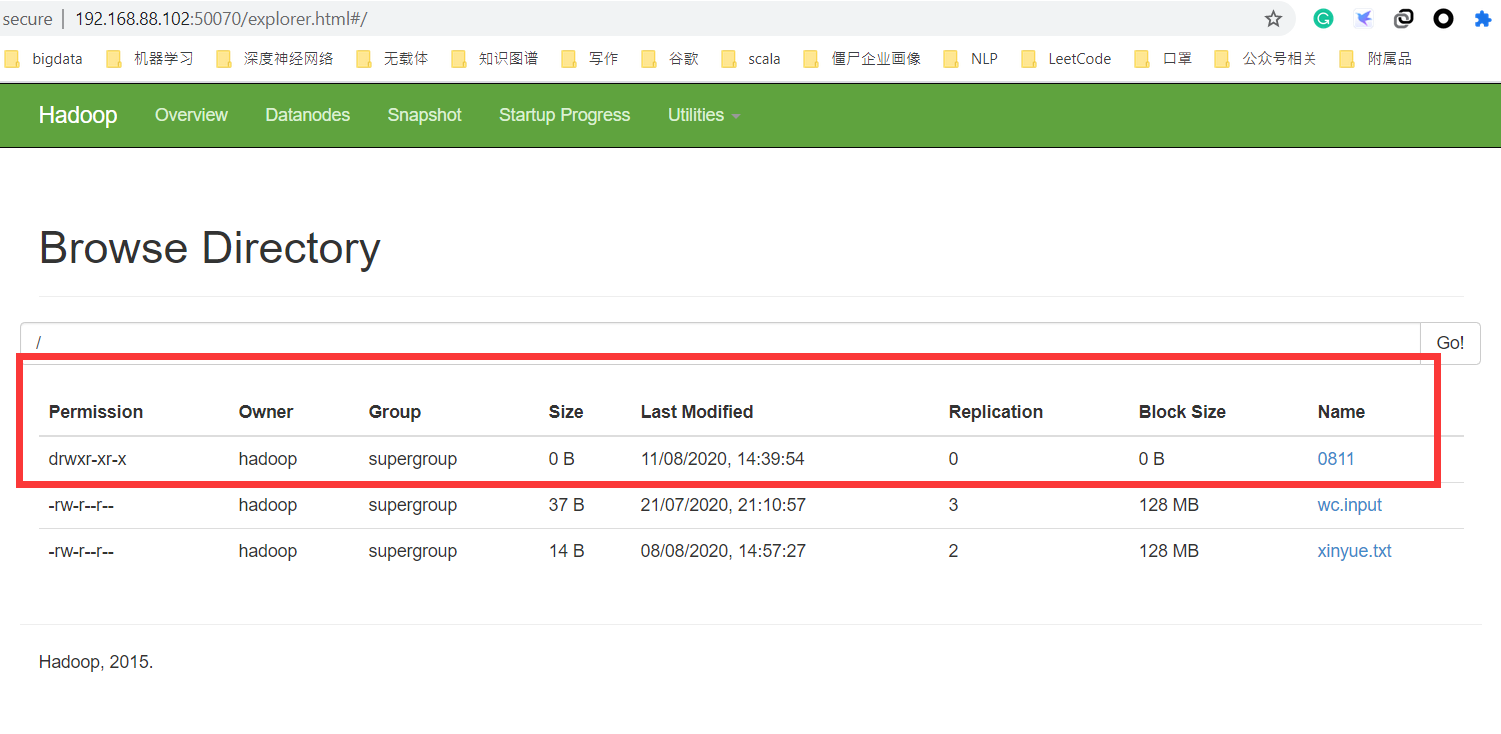

fs.mkdirs(new Path("/0811/boss"));

//3.關閉資源

fs.close();

System.out.println("over");

}

}

8.執行程式

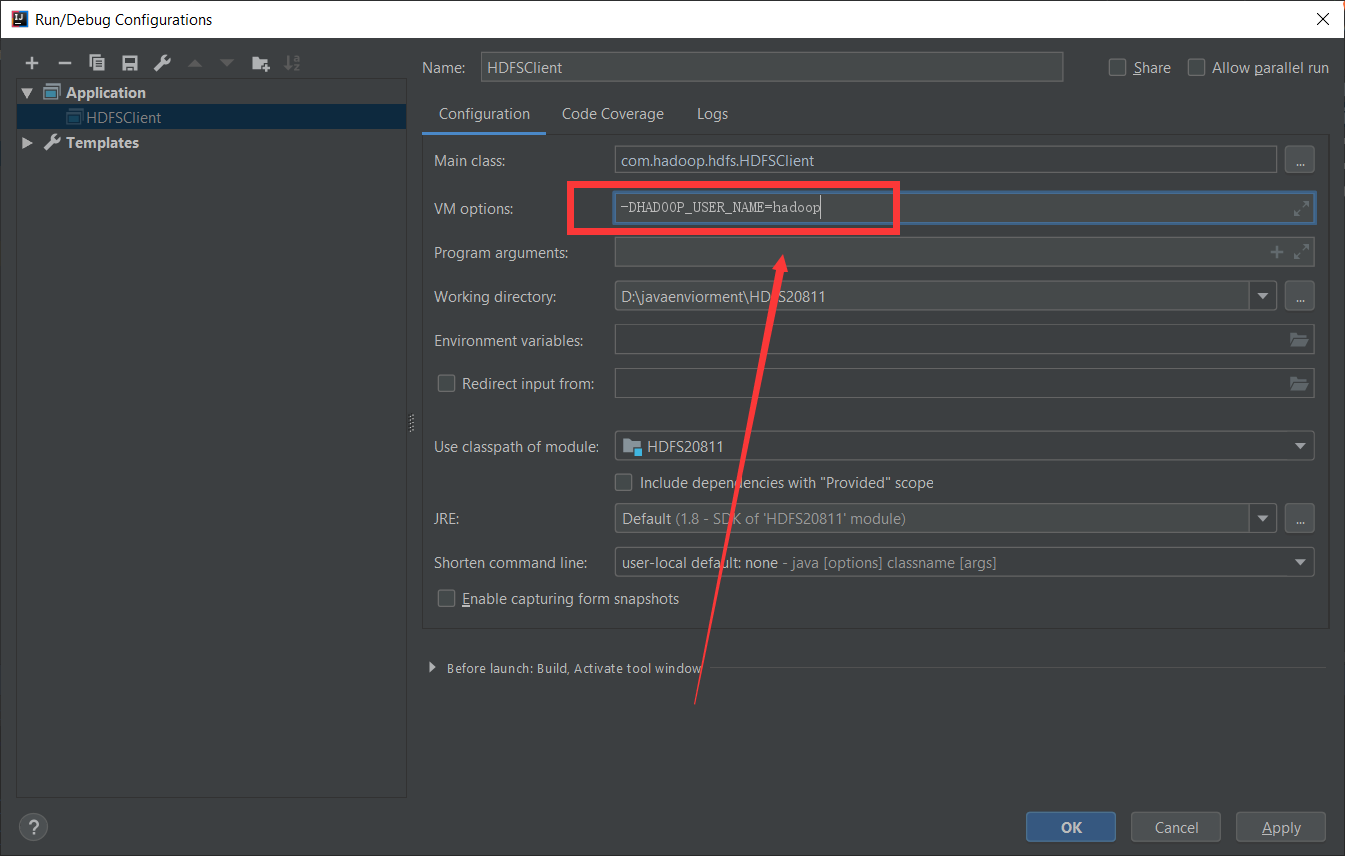

執行時需要設定使用者名稱稱,如圖所示

用戶端去操作HDFS時,是有一個使用者身份的。預設情況下,HDFS用戶端API會從JVM中獲取一個參數來作爲自己的使用者身份:-DHADOOP_USER_NAME=hadoop hadoop爲使用者名稱稱。

下面 下麪這種不需要設定也是OK的;

public class HDFSClient {

public static void main(String[] args) throws IOException, URISyntaxException, InterruptedException {

Configuration conf = new Configuration();

// conf.set("fs.defaultFS","hdfs://192.168.88.102:9000");

// //.獲取hdfs用戶端物件

// FileSystem fs = FileSystem.get(conf);

FileSystem fs = FileSystem.get(new URI("hdfs://192.168.88.102:9000"),conf,"hadoop");

//2.在hdfs上建立路徑

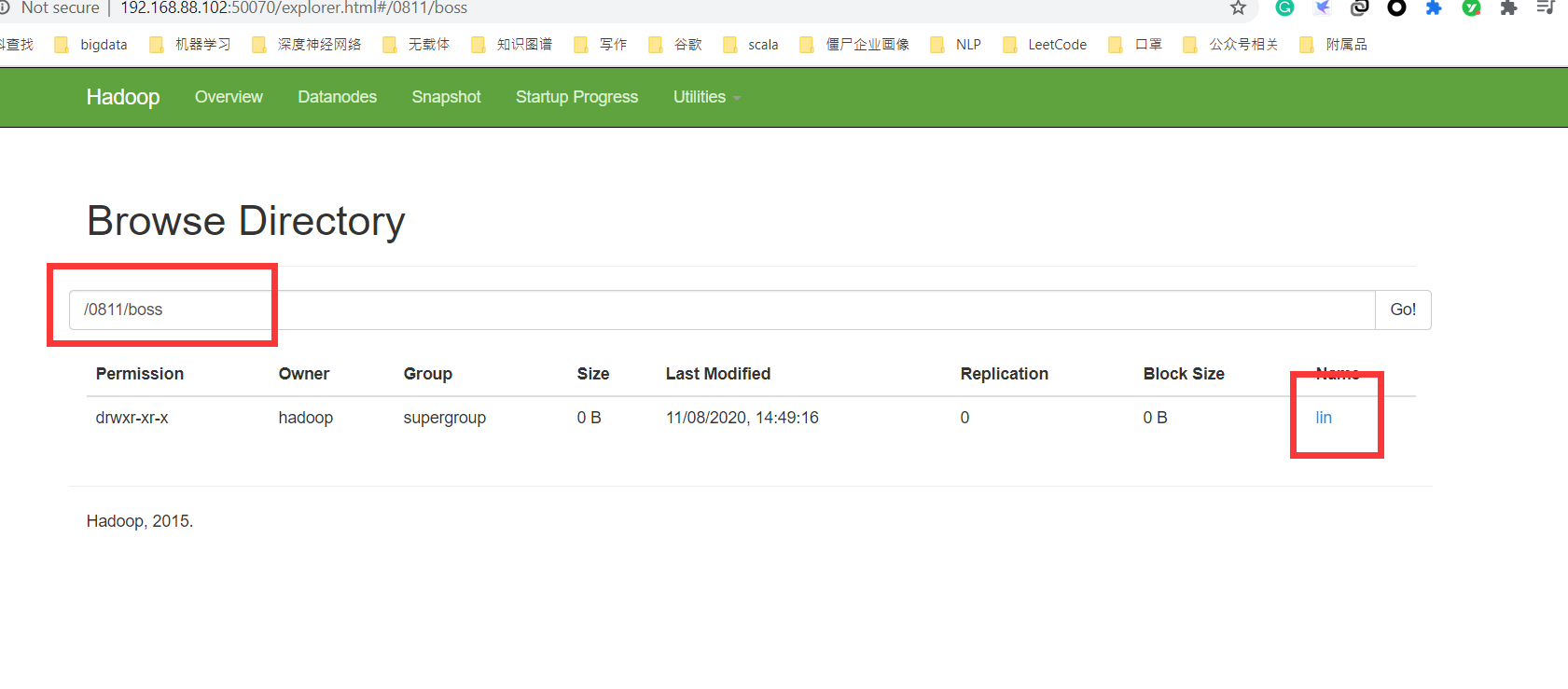

fs.mkdirs(new Path("/0811/boss/lin"));

//3.關閉資源

fs.close();

System.out.println("over");

}

}

幾百本常用電子書免費領取:https://github.com/XiangLinPro/IT_book