自然語言處理 Paddle NLP

2023-06-30 18:01:45

常見的對話系統

- 個人助手

•Apple Siri, Amazon Alexa, Baidu Xiaodu - 客戶服務•餐廳預定、商品諮詢、債務催收

- 休閒娛樂

•Microsoft XiaoIce,Replika

放域對話系統

- 檢索式系統

- 生成式系統

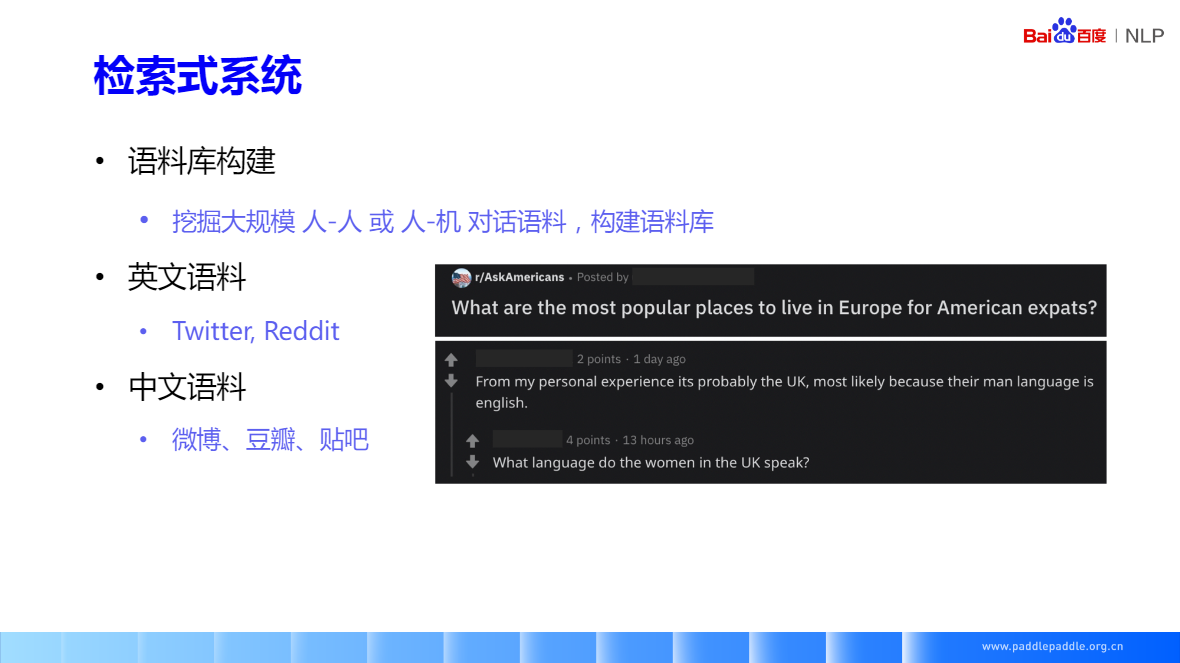

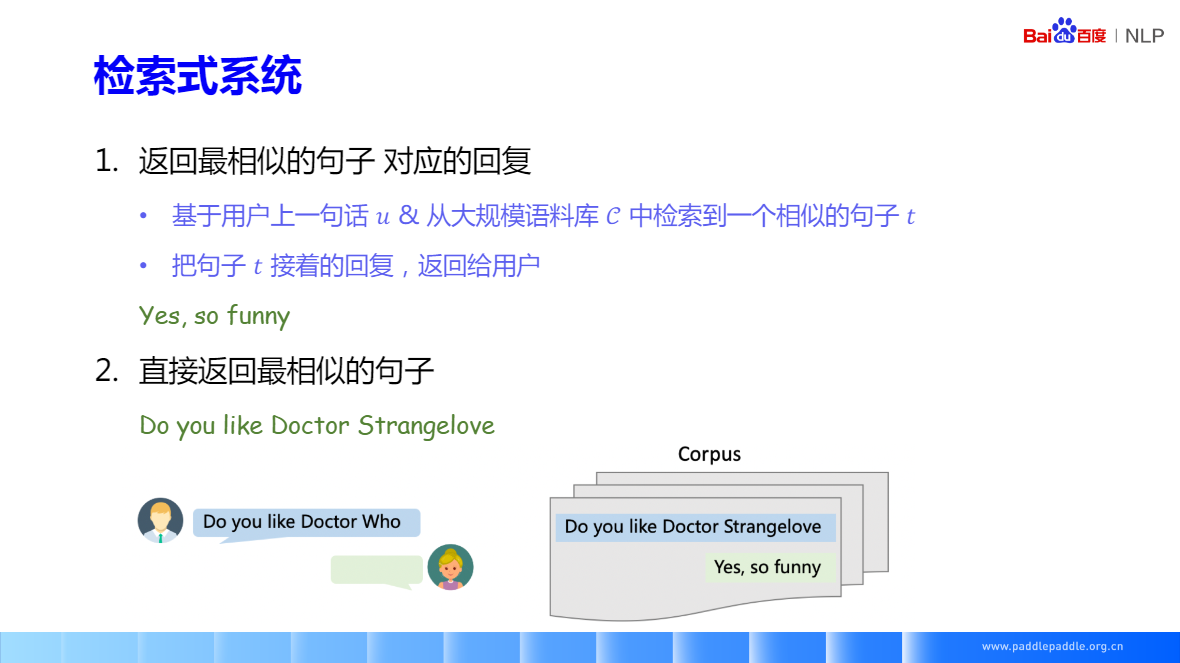

檢索式系統

生成模型

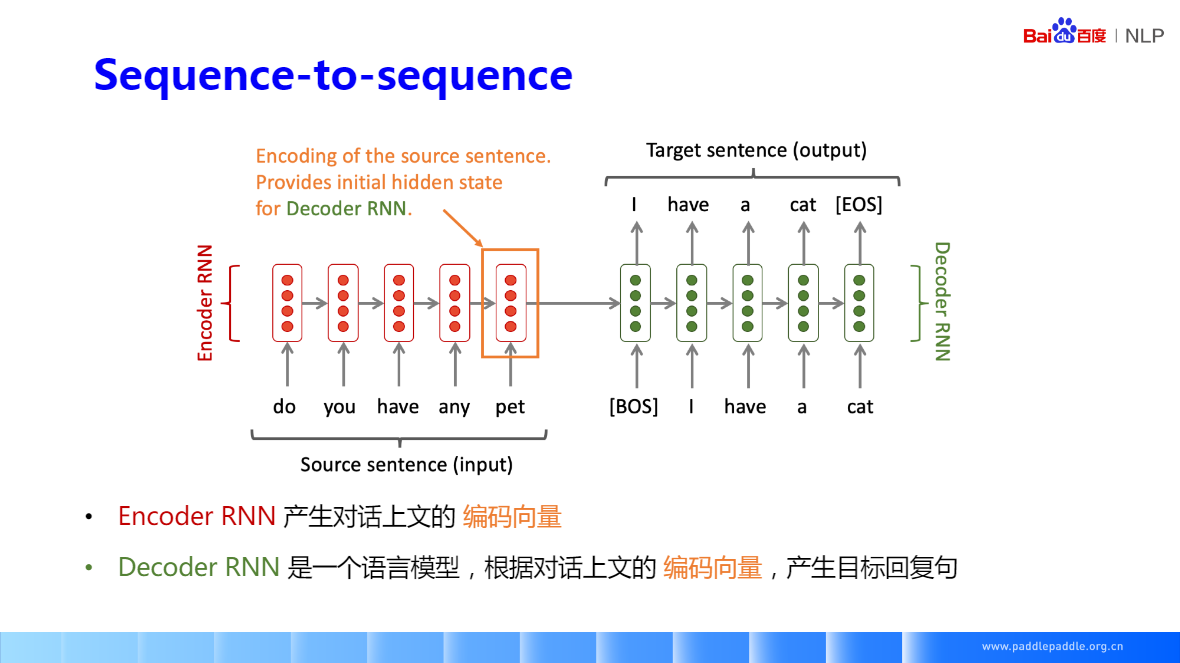

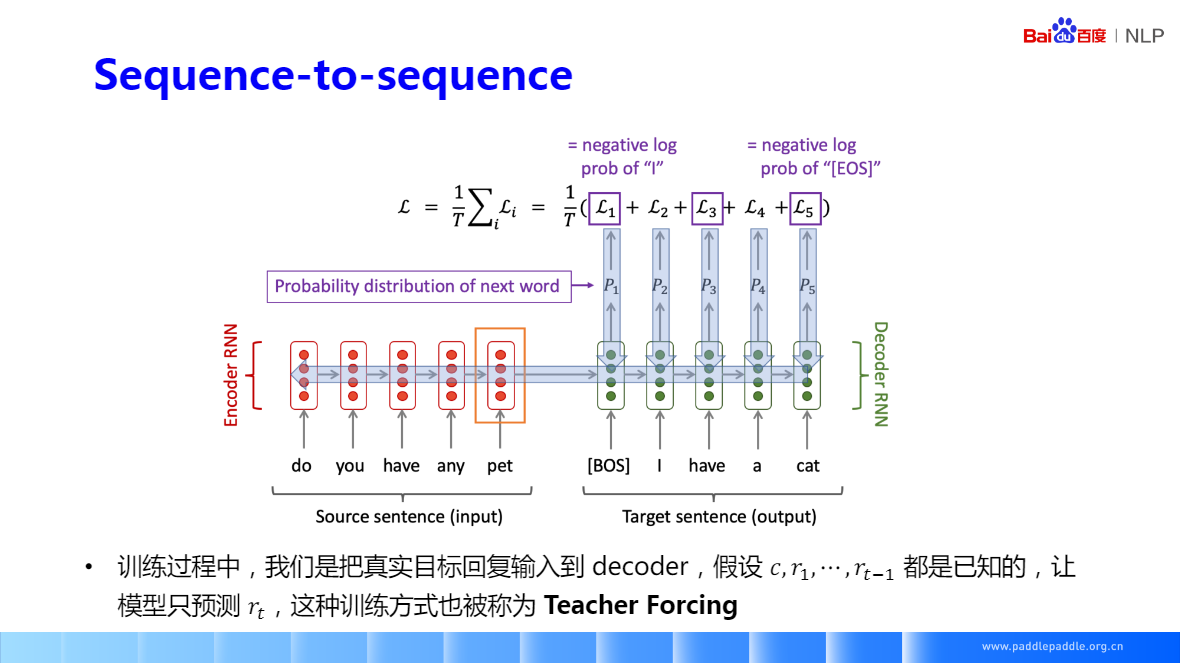

- Sequence-to-sequence

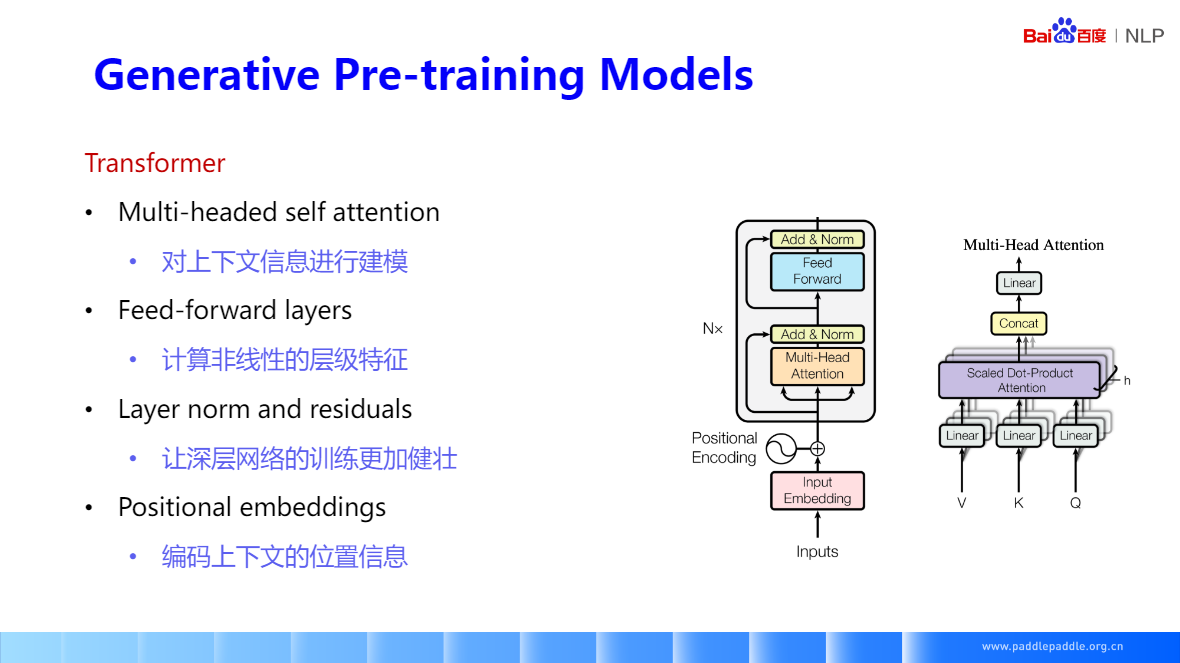

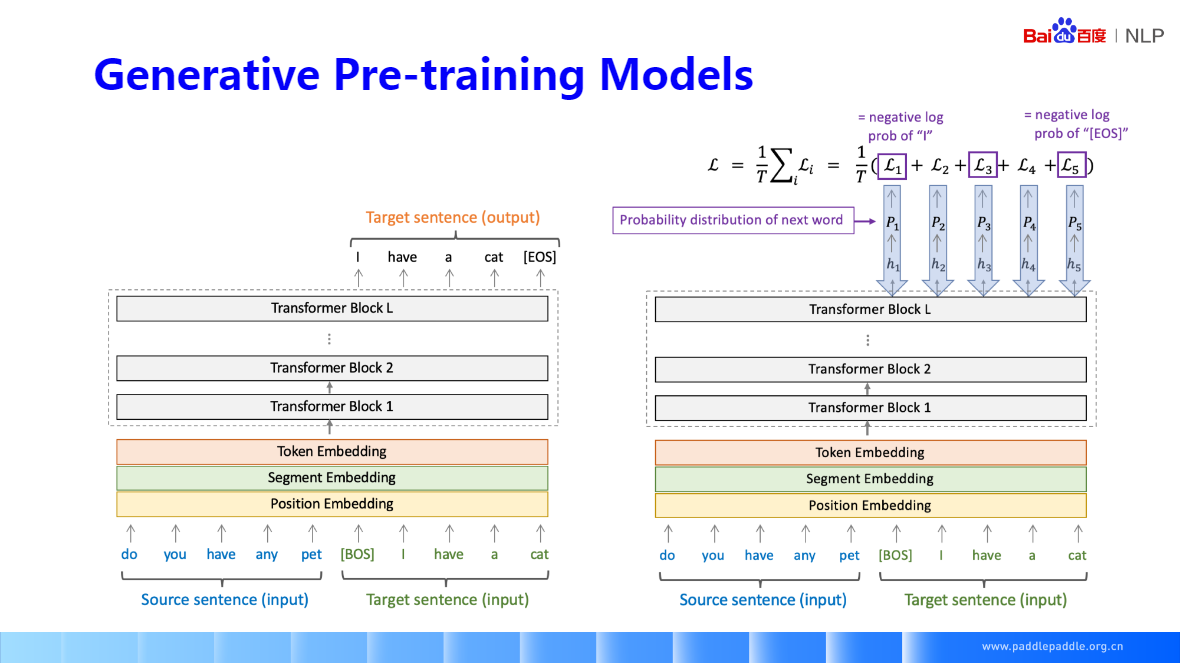

- Generative Pre-training Models

Sequence-to-sequence

Generative Pre-training Models

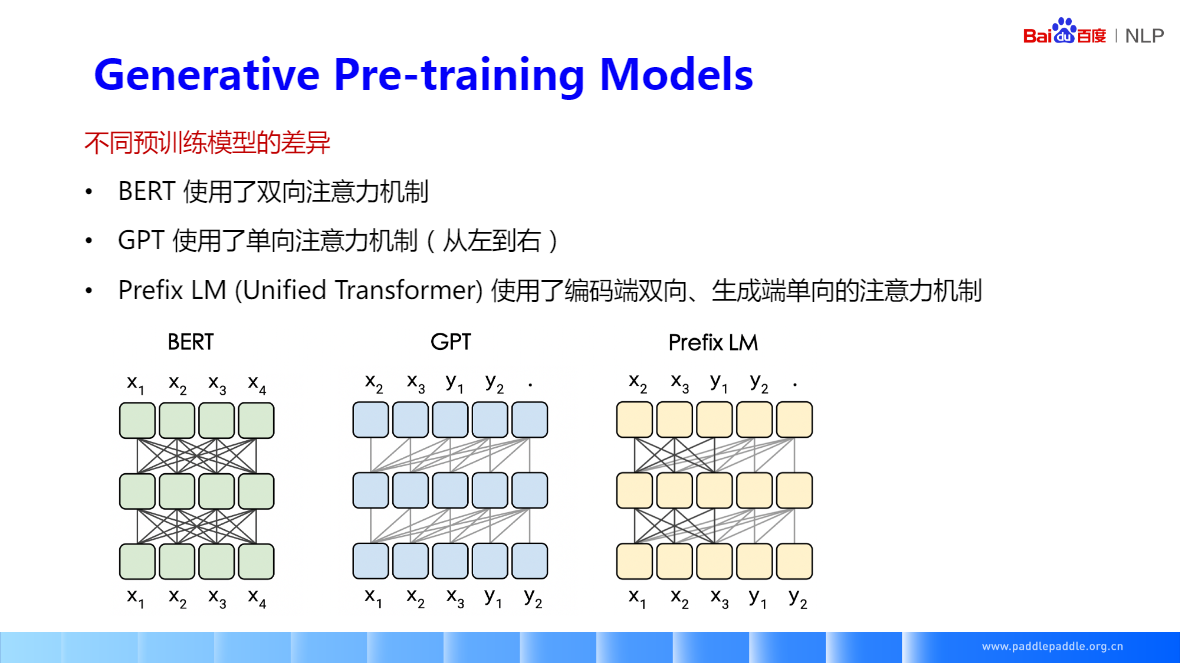

- BERT 使用了雙向注意力機制,每個token可以向左向右看到各個token

- GPT 使用了單向注意力機制(從左到右),是一個生成模型,每個 token只能看到自己和前他面的詞,只能看到以前的,所以比較適合用來做生成任務,像平常說話也是一個詞一個詞的,Q:你有沒有養寵物,A:我有一隻貓,

- PrefixLM (Unified Transformer)使用了編碼端雙向、生成端單向的注意力機制,適合開放域的對話任務

解碼策略

-

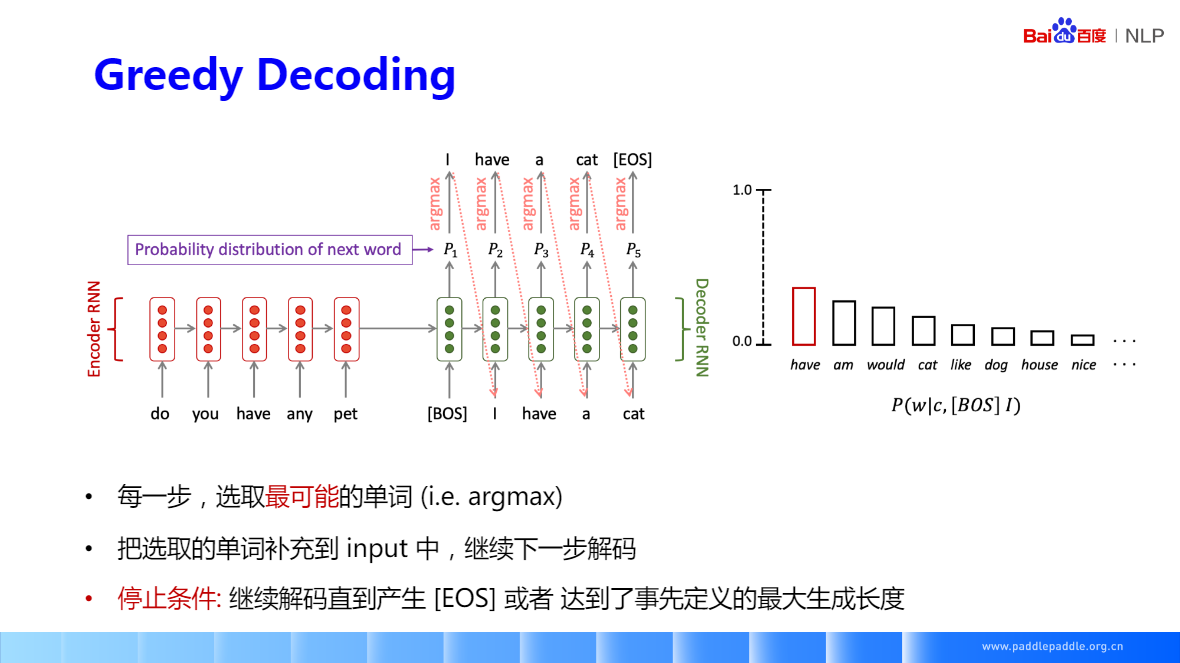

Greedy Decoding

-

Sampling-based Decoding

-

每一步,選取最可能的單詞(i.e. argmax)

-

把選取的單詞補充到input中,繼續下一步解碼

-

停止條件: 繼續解碼直到產生[EOS] 或者達到了事先定義的最大生成長度

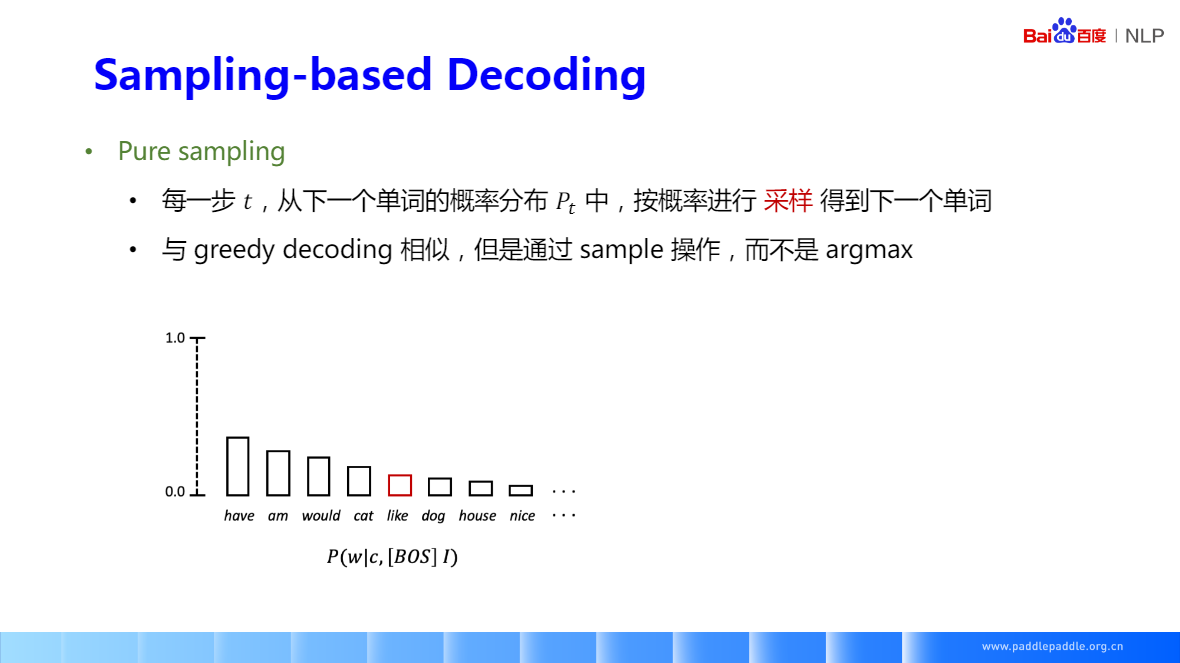

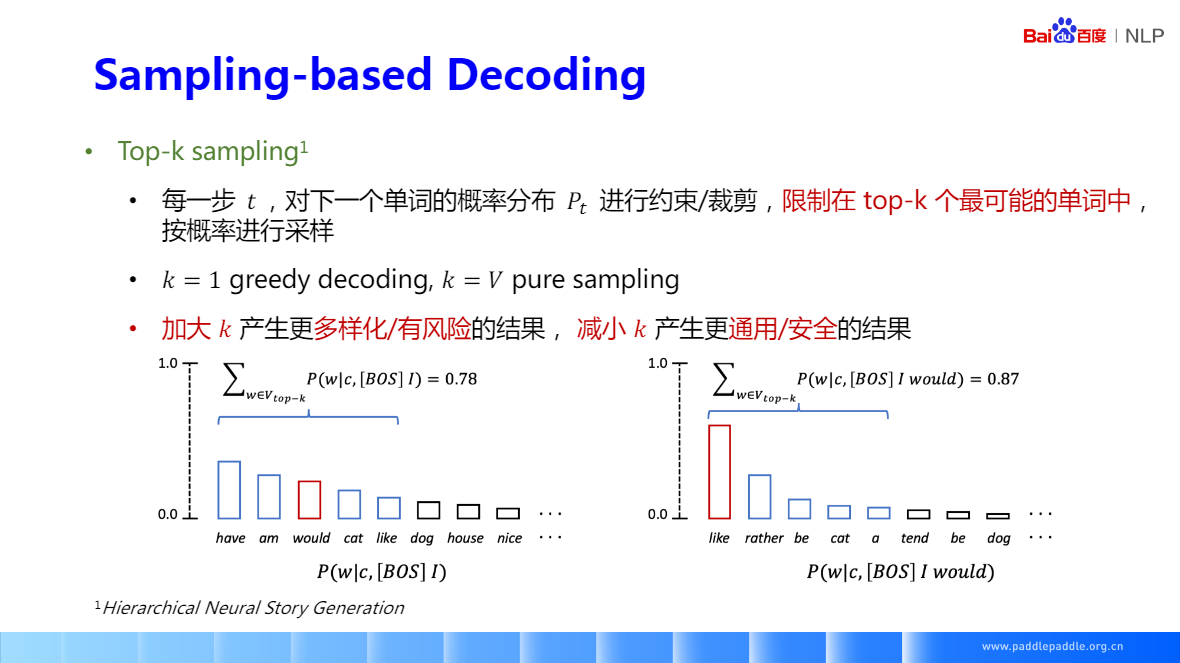

Sampling-based Decoding

解碼策略–總結

- Greedy decoding 方法很簡單,但效果一般較差

- Sampling-baseddecoding可以得到更多樣化/隨機的回覆

•比較適合於開放式/創造性的生成任務,像對話、詩詞、故事生成

•Top-k/p sampling 可以通過調節k/p,對生成的多樣性進行控制

對話評估

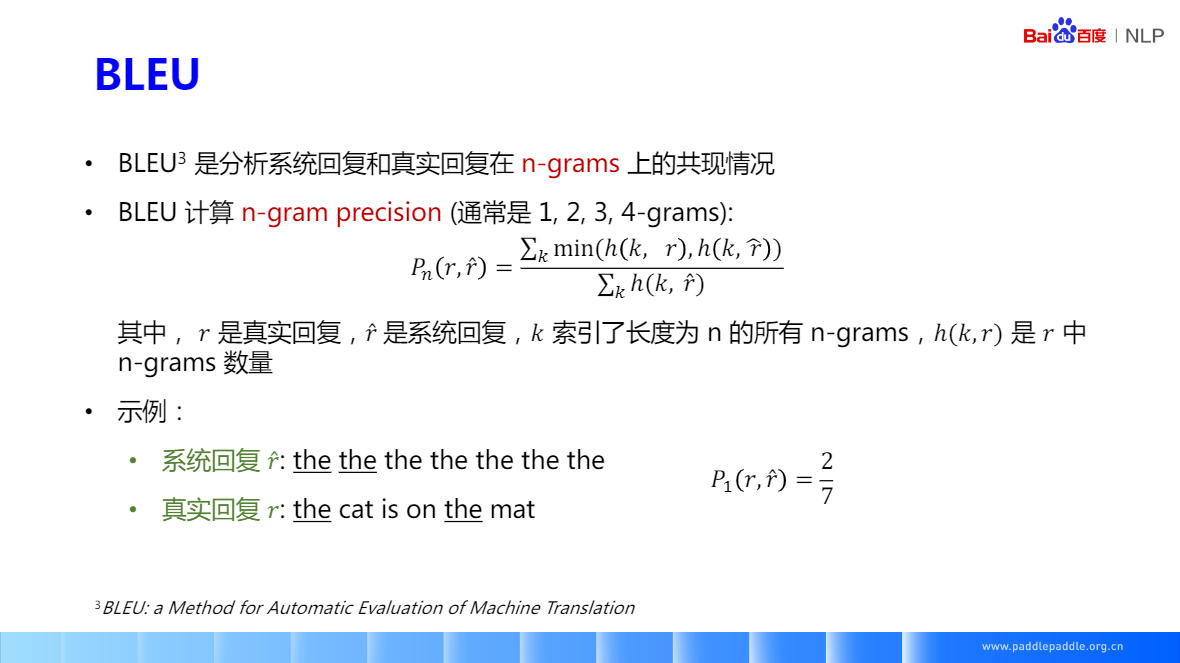

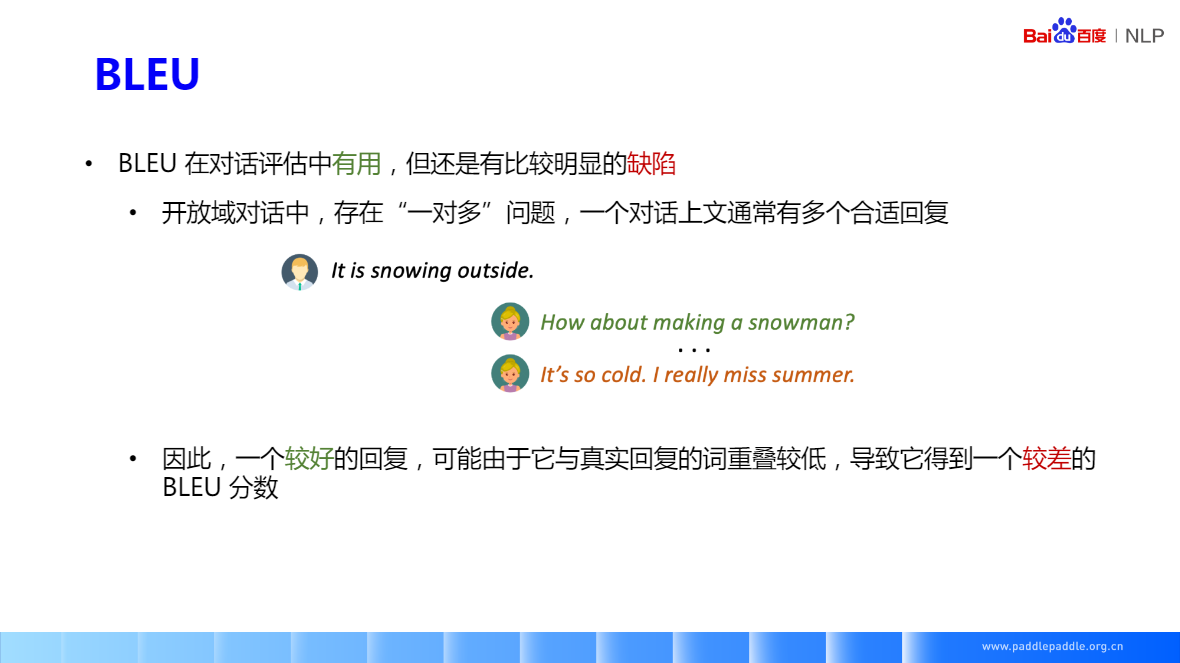

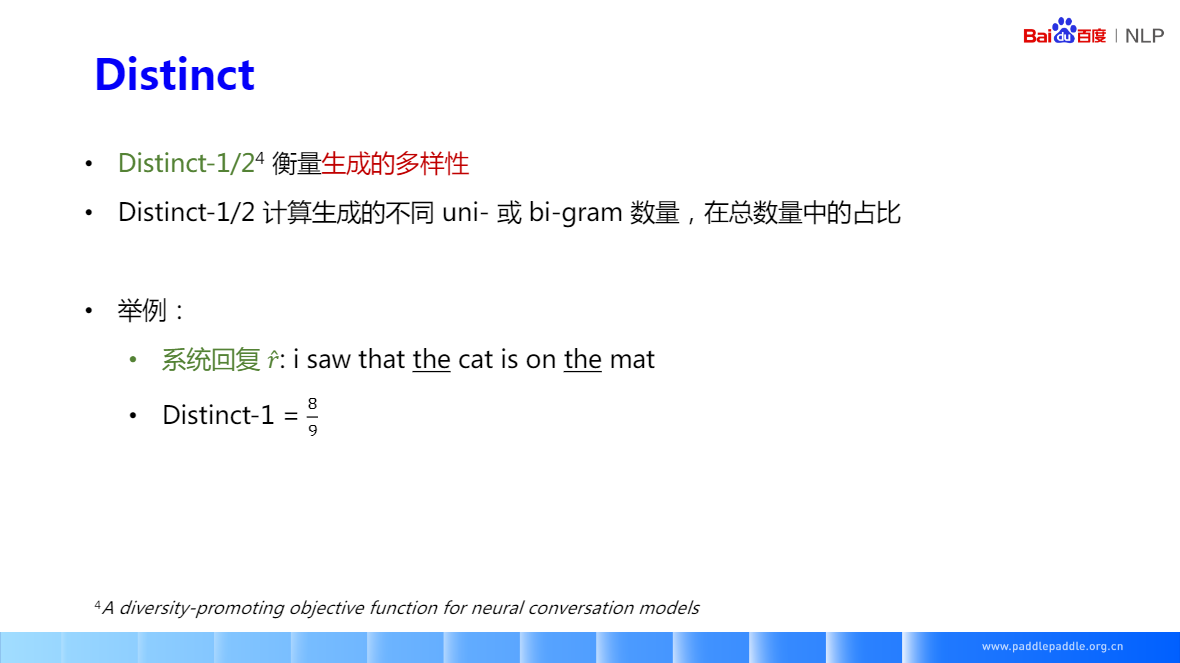

- 自動評估: BLEU、Distinct

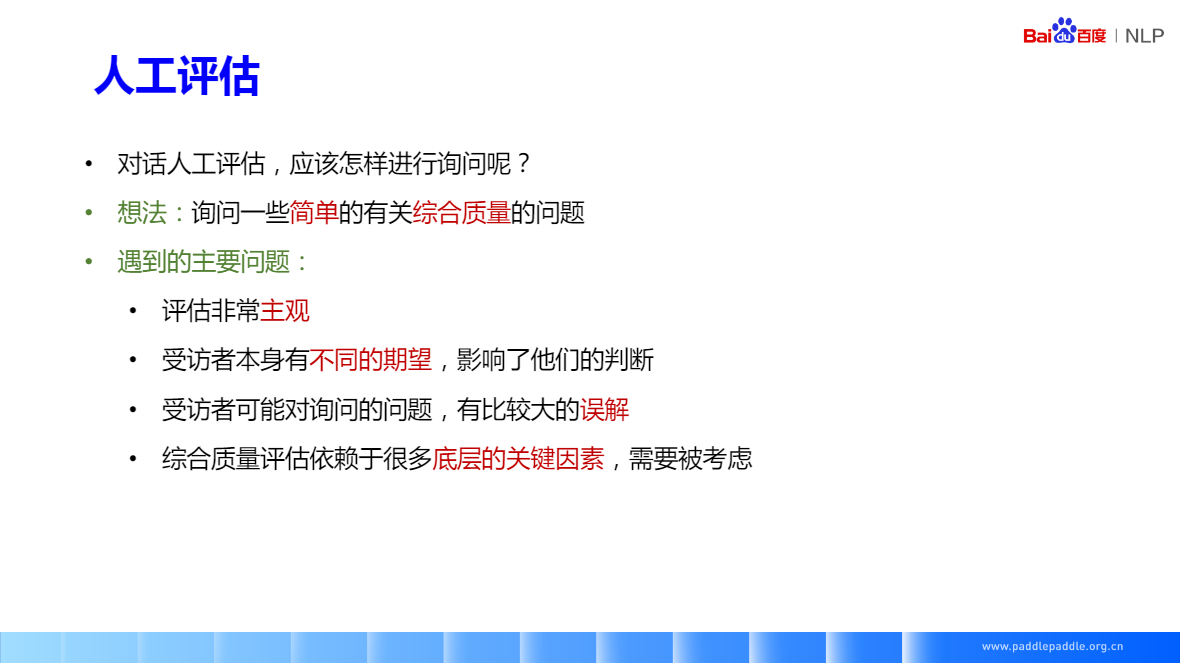

- 人工評估

BLEU

Distinct

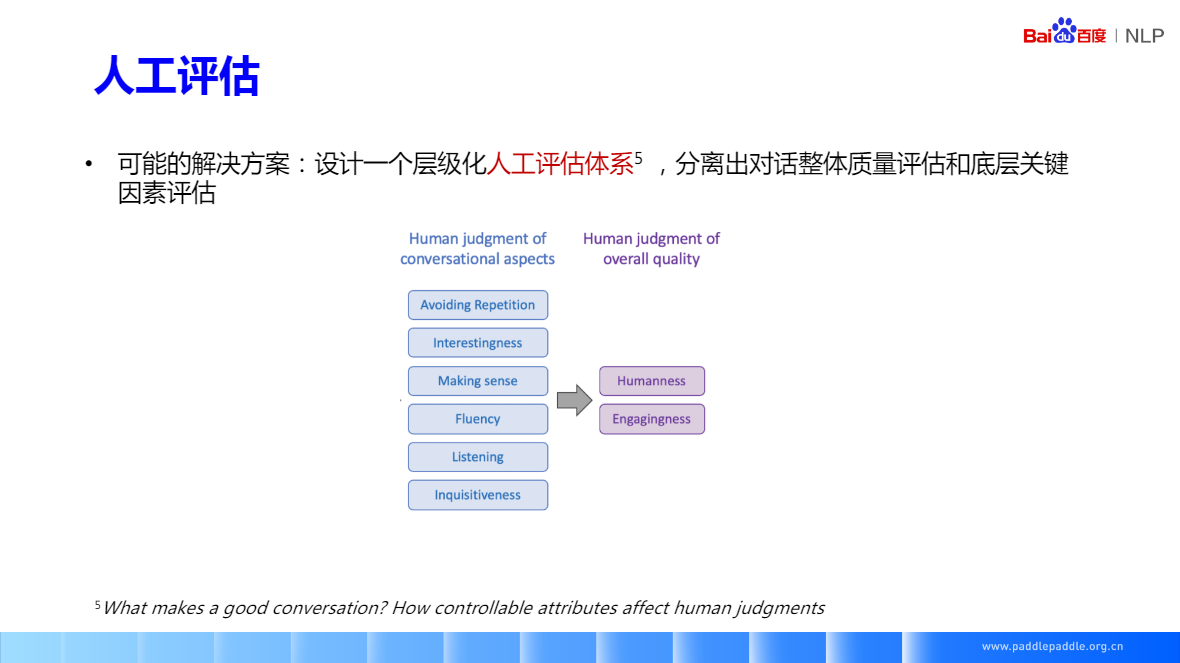

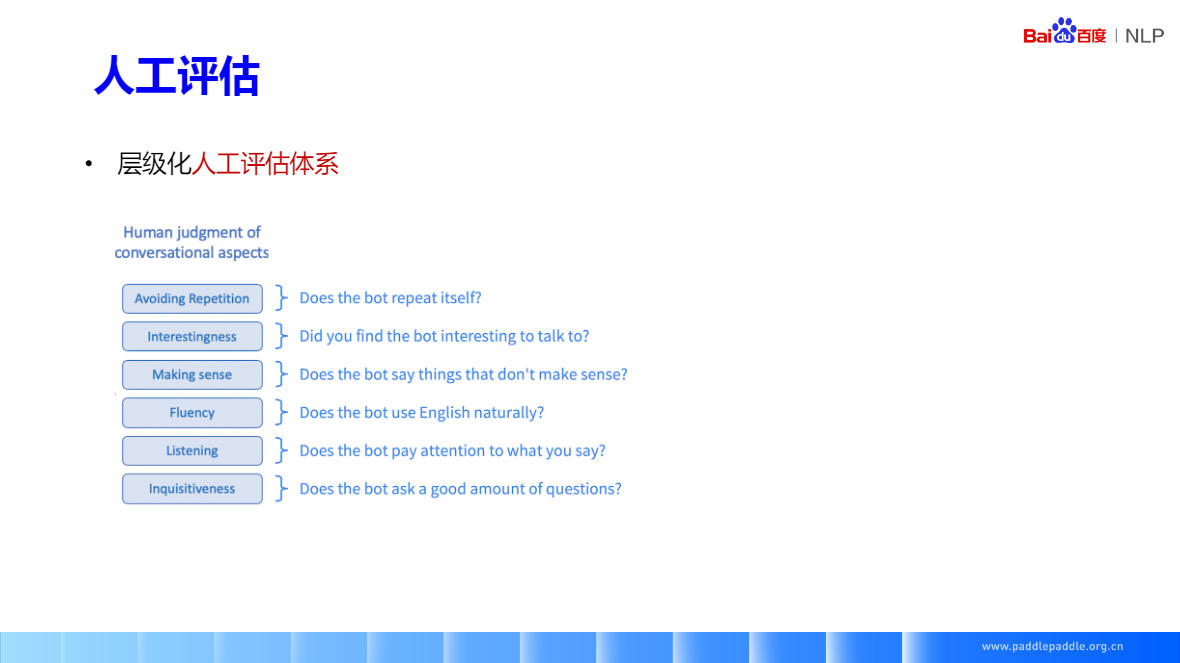

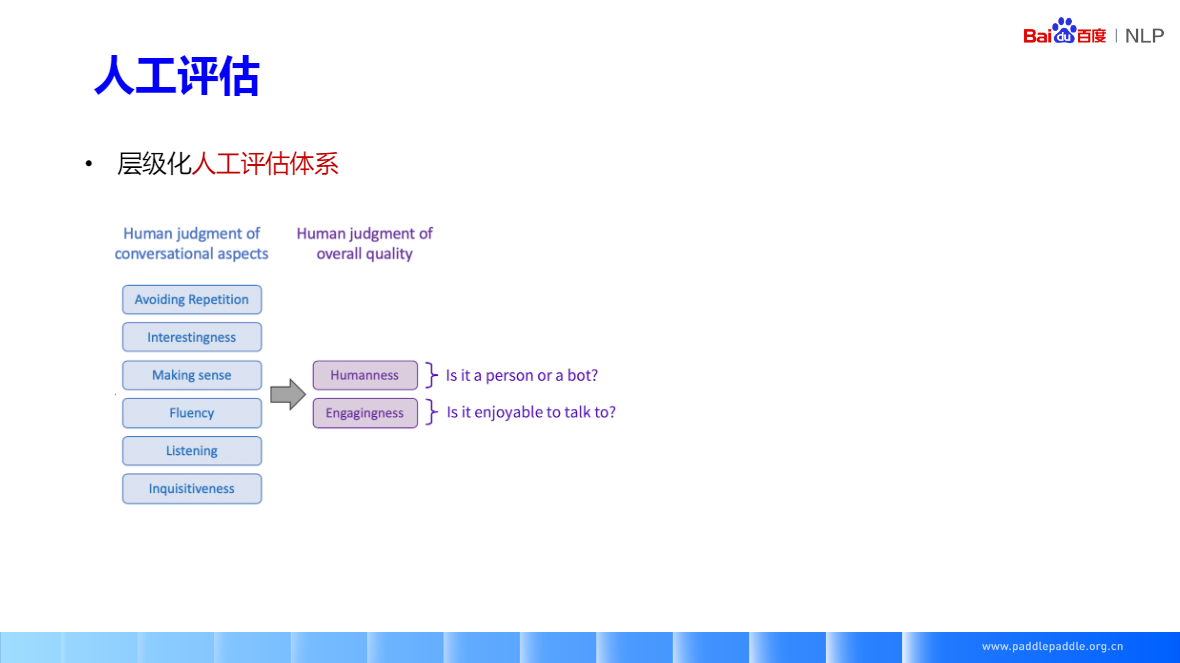

人工評估

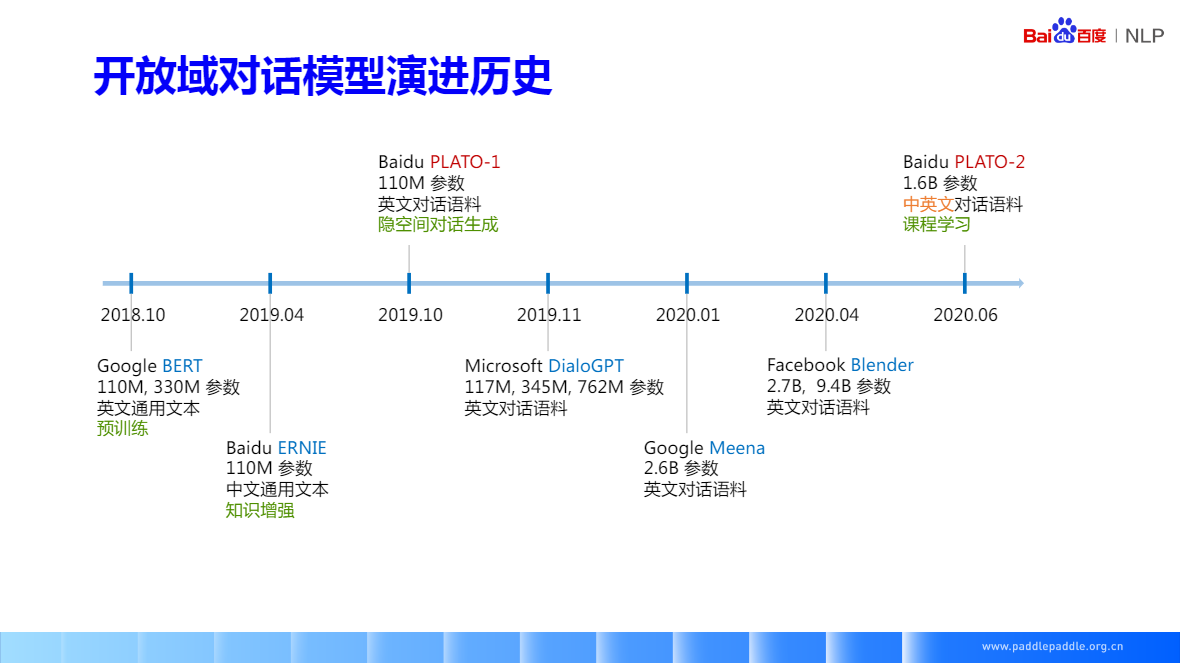

開放域對話模型演進歷史

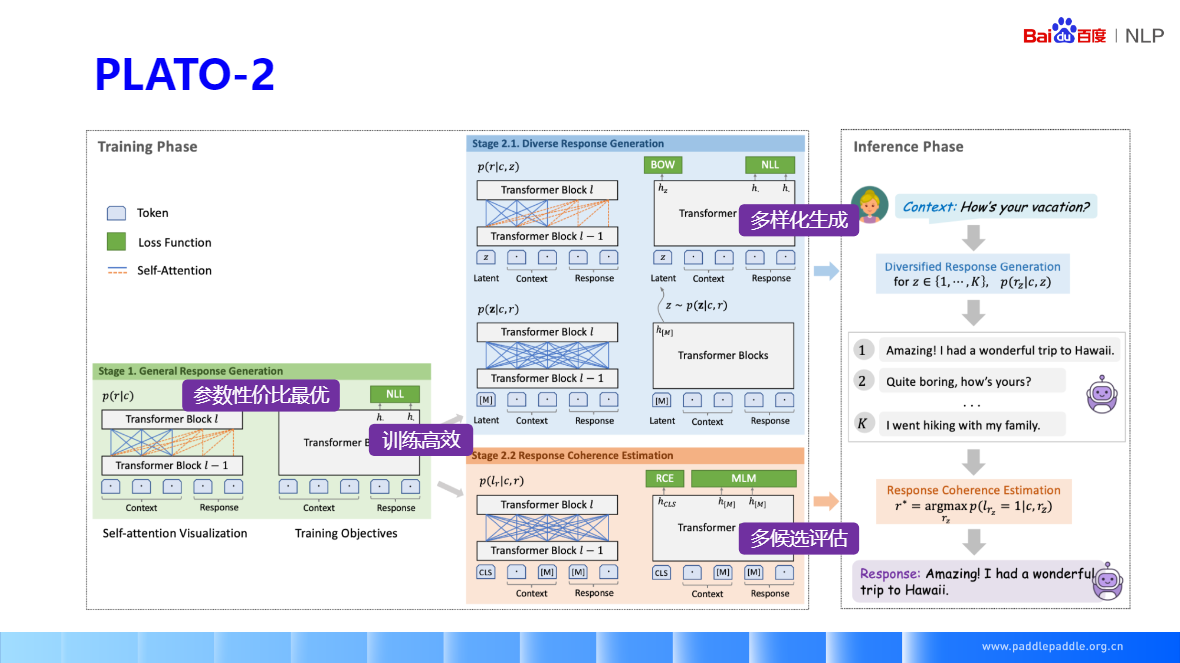

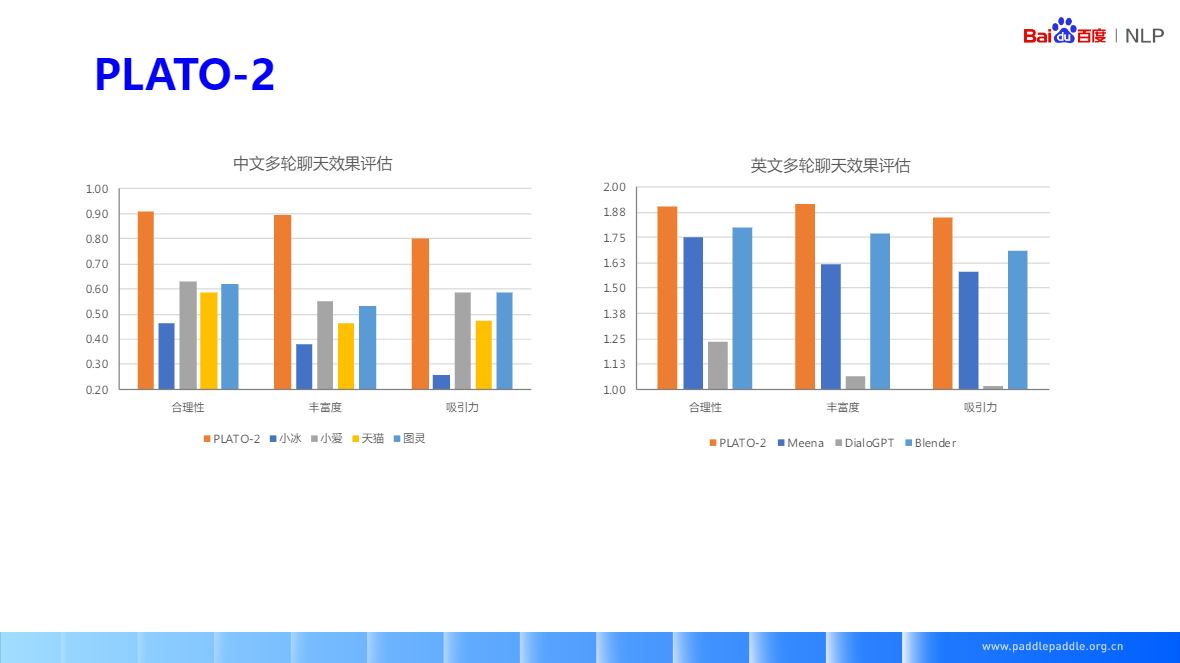

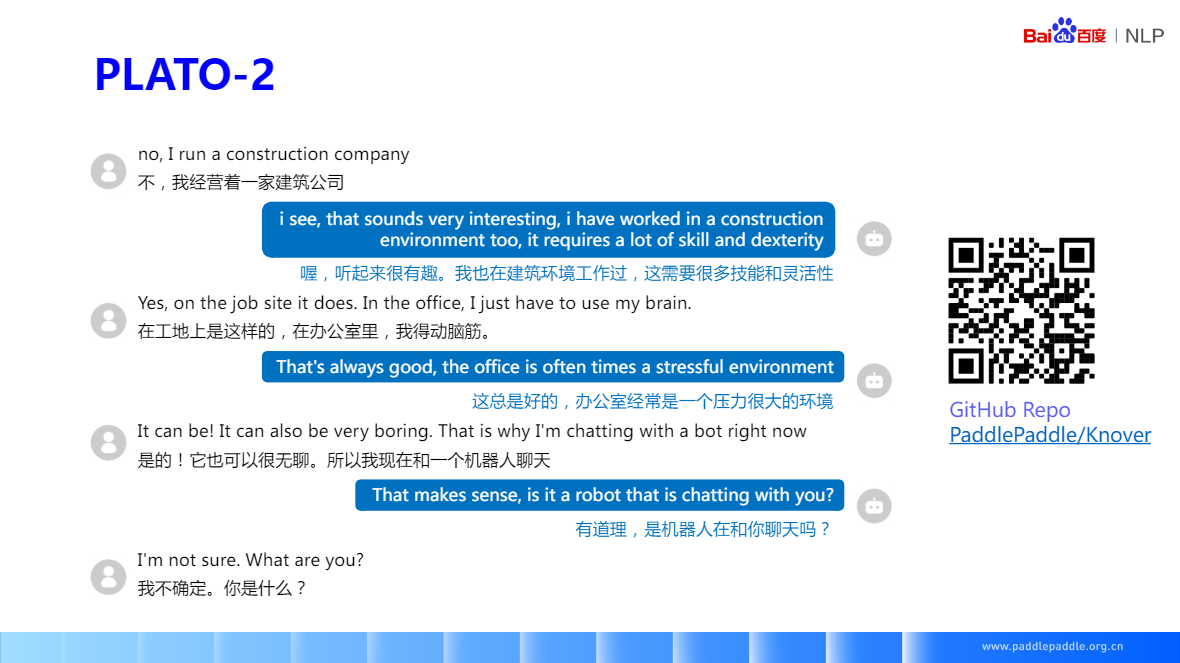

PLATO-2

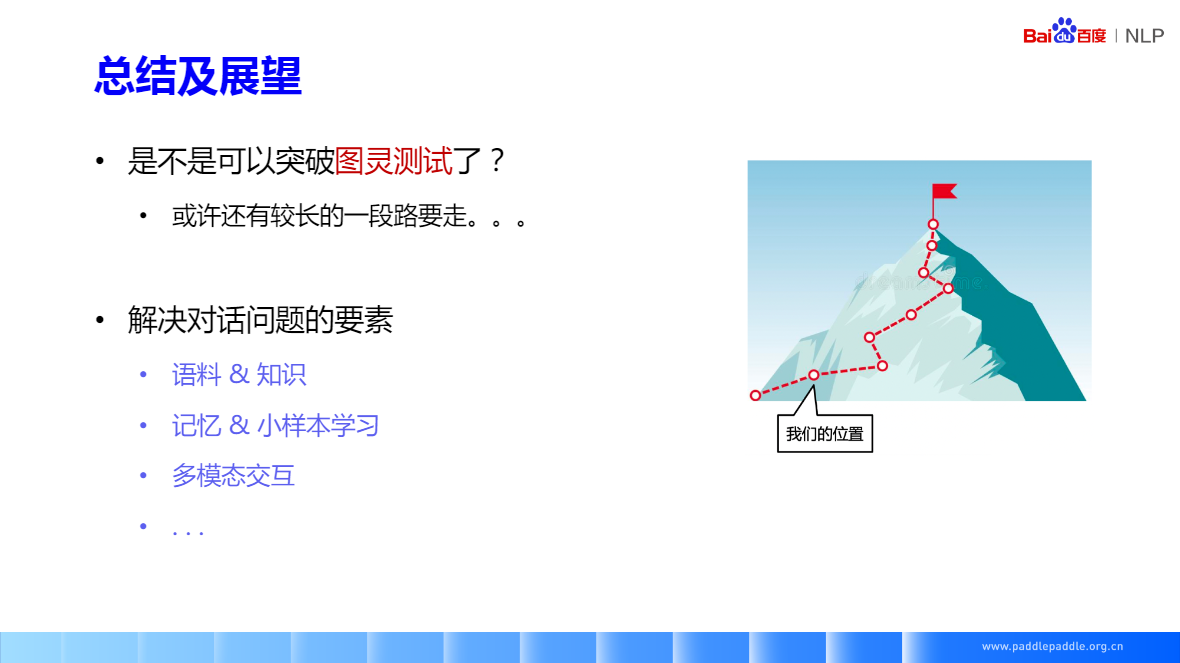

總結及展望

視訊:https://aistudio.baidu.com/aistudio/course/introduce/24177?sharedLesson=1493709&sharedType=2&sharedUserId=2631487&ts=1687157269113

課件:https://aistudio.baidu.com/aistudio/course/introduce/24177?sharedLesson=1567921&sharedType=2&sharedUserId=2631487&ts=1687157254946