江湖再見:毫米波雷達開發手冊之行為識別應用

寫在前面

深知新手在接觸毫米波雷達板硬體時需要花費的沉沒成本,因此在行將告別毫米波雷達之際,總結這兩年以來在毫米波雷達上的一些經驗和教訓。

本檔案用於為實現基於AWR1243BOOST等單板毫米波雷達開發提供參考指南與解決方案,主要包括硬體設定、基礎引數、訊號模型、應用DEMO開發以及可深入研究方向思考等;為更好地匹配後續級聯雷達應用的學習路線,在本手冊中會盡可能同化單板雷達和級聯雷達中的相關表述。

本指南作者資訊:Xl,聯絡方式:[email protected]。未經本人允許,請勿用於商業和學術用途。

希望後者在使用本指南時可以考慮參照作者在毫米波雷達旅途中的相關工作,如下所列:

[1] X. Yu, Z. Cao, Z. Wu, C. Song, J. Zhu and Z. Xu, "A Novel Potential Drowning Detection System Based on Millimeter-Wave Radar," 2022 17th International Conference on Control, Automation, Robotics and Vision (ICARCV), Singapore, Singapore, 2022, pp. 659-664, doi: 10.1109/ICARCV57592.2022.10004245.

[2] X. Yu, Z. Cao, Z. Wu, C. Song, J. Zhu and Z. Xu, "Sample Intercorrelation Based Multi-domain Fusion Network for Aquatic Human Activity Recognition Using Millimeter-wave Radar", in IEEE Geoscience and Remote Sensing Letters, 2023, doi: 10.1109/LGRS.2023.3284395.

[3] Z. Wu, Z. Cao, X. Yu, C. Song, J. Zhu and Z. Xu, "A Novel Multi-Person Activity Recognition Algorithm Based on Point Clouds Measured by Millimeter-Wave MIMO Radar", in IEEE Sensor Journal.

本章節為應用DEMO開發,主要討論筆者在研究生階段的毫米波雷達水上行為識別工作,包括本領域的研究進展剖析概述、工作成果展示等。

歡迎各位讀者通過郵件形式與筆者交流討論,本章節完整程式請私信筆者,希望使用本程式碼時能夠提供一份參照和Star,以表示對筆者工作的尊重,謝謝!在後續將定時維護更新。

https://github.com/DingdongD/aquatic-activity-dataset 【水上資料集AHAR-I/AHAR-II】

https://github.com/DingdongD/SIMFNet 【TSFNet/SIMFNet】

往期內容:

厚積薄發:毫米波雷達開發手冊之大話恆虛警率檢測

一統江湖:毫米波雷達開發手冊之大話線譜估計

爐火純青:毫米波雷達開發手冊之大話空間譜估計

登堂入室:毫米波雷達開發手冊之訊號模型

初出茅廬:毫米波雷達開發手冊之基礎引數

揚帆起航:毫米波雷達開發手冊之硬體設定

眼觀四海:自動駕駛&4D成像毫米波雷達 如今幾何?

雷達人體行為識別領域研究概述

現前的研究中,雷達人體目標識別可以歸納為:目標定位與目標理解。目標定位是基於毫米波雷達感測器對人體進行定位,獲取人體目標的運動速度、方位、軌跡等資訊;目標理解是基於經驗模型或智慧演演算法學習雷達訊號與人體行為或狀態的對映關係,實現人體行為的深層語意理解與分析。兩者是相互反饋與作用的,目標定位通過感知環境中目標的存在,為目標理解提供可靠的訊號輸入;目標理解通過從雷達訊號中抽象出高階表徵,反饋於目標定位環節以驗證目標存在的真實性。

根據人體不同部位的運動形式分析,人體運動可以認為是宏運動、微運動、生命體徵運動的疊加。宏運動是指目標軀體相對雷達視距上的位移運動,微運動是指目標肢體等部位引起的微小運動,生命體徵運動是指目標因呼吸、心跳引起的胸腔位移。對應地,目標理解可以細分為手勢識別、步態識別、動作識別、生命體徵識別等子任務。其中,手勢識別是指通過雷達訊號的細粒度分析以理解目標手部運動的語意資訊,這種任務對雷達工作解析度要求較高;步態識別是通過提取雷達訊號中不同的步態特徵,關聯目標身份與步態特徵,以實現不同目標的身份識別、異常檢測;生命體徵識別是通過提取目標相位訊號解析出心跳、呼吸等特徵實現生命健康監測;動作識別是指通過分析雷達訊號中多種疊加的特徵或模式,以匹配目標最相關的運動狀態或型別。綜上任務,動作識別(狀態檢測)任務適配本文所研究的溺水檢測課題,因此,在下述討論中將側重關注雷達人體動作檢測在傳統機器學習與深度學習方法方向的研究成果。

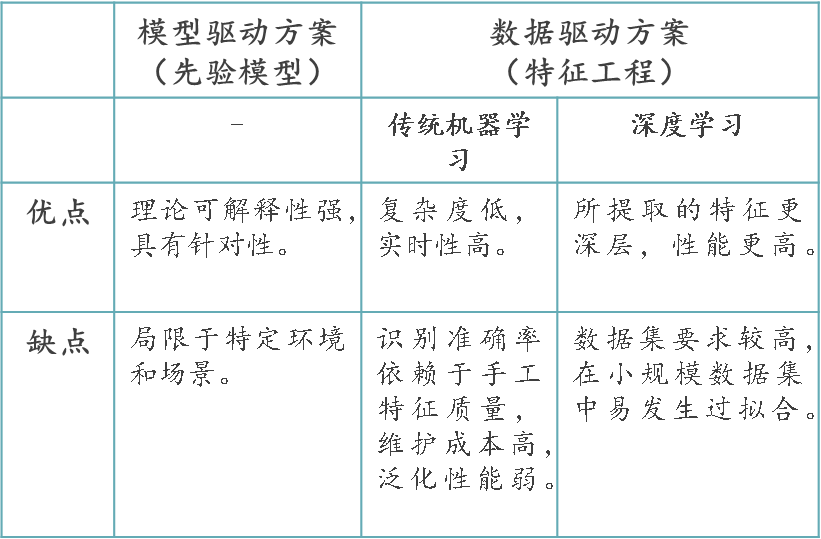

傳統機器學習是通過支援向量器、多層感知機、最近鄰演演算法及主成分分析等方法來學習輸入資料的淺層特徵以實現分類任務,這種複雜度較低,可滿足實時性要求,但依賴於手工提取的資料特徵質量,手工特徵提取成本較高,可維護性和泛化性較差,不適合複雜動作識別任務場景。早期,Young Kim等人使用多普勒雷達收集了12名受試者進行7種不同活動的測量資料[1],並從生成的時變多普勒影象中提取出了6類特徵,這些特徵輸入在ANN與SVM上可實現近90%的檢測準確率。Zhang等人使用X波段雷達收集了5種不同人體活動的資料[2],並從經短時傅立葉變換後的時頻影象中提取了4種特徵作為KNN分類器的輸入,最終實現了85%的檢測準確率。

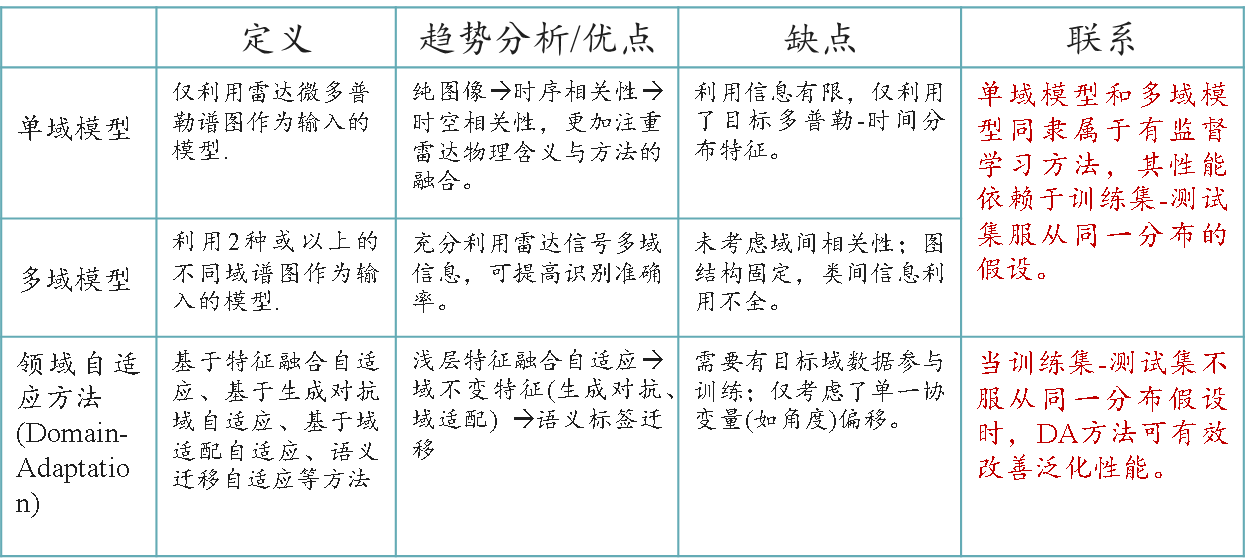

相較前者,深度學習方法更關注於資料的深層特徵,旨在通過學習輸入資料與標籤資訊的對映或輸入資料的分佈,使模型能夠有效預測輸出。近年來,不同的深度學習方法被提出用於雷達人體動作識別,並都實現了可觀的效果。從深度學習模型類別的觀點分析,深度學習包括不同的網路模型(深度折積神經網路、迴圈神經網路、Transformer、及圖折積神經網路等)與學習正規化(對比學習、遷移學習及元學習等)。從雷達訊號資訊利用率的觀點分析,深度學習可分為單域模型和多域融合模型,單域模型通常指僅將1種具有特定分佈資訊的譜圖(如微多普勒譜圖)作為輸入所設計的網路模型,多域融合模型則是指利用2種或以上譜圖(包括距離-方位、距離-多普勒、節奏速度等譜圖)作為輸入所設計的融合模型。

Jokanovic等人在基於雷達跌倒檢測任務中採用了由2個堆疊自動編碼器和Softmax迴歸分類器構成的DNN模型[3],實驗結果證實DNN方法優於傳統方法。Li等人提出了1種基於雷達微多普勒、資料增強和深度神經網路(8層CNN結構)的人體活動檢測方法[4],這種方法可以實現99%以上的分類精度。He等人基於MOCAP模擬人體活動資料集設計了1種合適的CNN架構[5],通過討論表明了增加網路層的深度並不總是有助於提高分類精度,應儘可能增加特徵圖的數目並使其大小保持中等尺寸。深度折積神經網路具有較強的空間特徵提取能力,能夠從不同人體動作對應的微多普勒譜圖中提取出可區分性表徵,但是這種深度模型複雜度較高,在小規模資料集上易發生過擬合。因此,Hao等人在MOCAP資料集上應用基於ImageNet資料集遷移的殘差網路來實現不同人體動作的分類[6],相較常規CNN方案平均識別準確率提升了6%。Seyfioğlu等人指出由雷達譜圖相關資料預訓練得到的模型比傳統隨機初始化或使用無關的光學影象資料訓練的模型引數初始化等正規化具有更為有效的效果,所提出的基於MOCAP資料預訓練和實測資料微調的DivNet在7分類和11分類人體動作識別上均可取得優異效果[7]。遷移學習有效地降低了模型對資料的需求,提高了訓練準確率和收斂速度,但這種方法難以保證模型學習到源輸入的細節特徵。為了使模型更好地學習到源輸入的語意資訊,自動編碼器被用於提取輸入微多普勒譜圖的深層特徵[8],這種模型通常以最小化重建損失的形式聯合有監督分類任務進行訓練,有效地提升了模型的泛化效能,並降低了模型過擬合風險。上述方法是基於「雷達微多普勒譜圖可視為傳統影象」的出發點所提出的,實際上微多普勒譜圖可認為是多通道一維時間序列,富含豐富的時序相關性資訊。基於此,Aman Shrestha等人將微多普勒譜圖或距離-時間譜圖視為連續時間序列影象資料[9],提出了遞迴LSTM和雙向LSTM網路結構用於連續活動檢測和識別,實現了流行為的實時預測輸出,經優化後的Bi-LSTM網路結構在45個不同活動序列中的分類準確率可達到90%以上,證明了雙向LSTM可以有效地提取序列資料中前向與後向的時序相關性。Wang等人提出了帶有LSTM單元的堆疊式RNN模型從雷達微多普勒譜圖中自動提取序列特徵[10],最終以92.65%的分類準確率實現了6種不同人體活動的識別。

事實上,單純依靠時序相關性實現不同人體活動的分類是較為困難的:一方面,人體動作的前後轉換存在相似性與干擾行為,動作累積時間短,以致模型難以捕捉到特定表徵;另一方面,時序網路自身存在收斂慢、易振盪。為了彌補特定網路提取微多普勒特徵的缺陷,時序網路可配合折積神經網路以更深地提取出微多普勒譜圖中的時空特徵,Chen等人在IET Radar Challenge中提出了一種基於折積編碼器和殘差LSTM組合的時空網路結構[11],利用編碼器結構有效地保證了模型學習到微多普勒譜圖中的語意資訊,並且用LSTM結構提取了時序相關性,最終在6分類任務集上實現了93.8%的SOTA效果。Zhu等人首次提出了「雷達微多普勒譜圖可視為多通道時間序列」的觀點[12],通過用1DCNN和LSTM的級聯結構來提取譜圖中的時空資訊,在7分類人體活動資料集上實現了98.28%的效果,並且比深度折積神經網路的效能更為優越。

隨著人體行為的多元化和複雜化,不同行為對應的雷達微多普勒譜圖可能會高度相似、混淆,因此,現有的依賴微多普勒譜圖作為資料輸入的單域模型,恐難以在複雜人體活動識別中保持高檢測效能。為此,雷達多維資訊的利用是新場景下提高人體活動識別效能的關鍵切入,Ding等人提出了首個雷達多域資料融合網路(MDFRadar Net)[13],這種網路考慮了距離-多普勒、微多普勒及近距離-時間譜圖資訊的充分利用,使用了1DCNN和LSTM的級聯模型來提取微多普勒和距離-時間譜圖中的時空特徵,並用2DCNN來提取距離-多普勒譜圖中的空間特徵,再將從3個分支得到的特徵向量根據可學習加權策略進行融合,最後輸出分類結果;相比單域模型,這種方法充分地利用了雷達訊號的豐富語意特徵,進而提升了分類效能。MDFRadar Net雖充分利用了雷達不同域的語意資訊,但忽略了不同域資料間的關聯與互動,因此,Wang等人將距離-時間、多普勒-時間、距離-多普勒譜圖視為三個節點,這3個節點滿足「全連通」關係,經CNN提取每個域譜圖的特徵向量作為節點特徵,基於節點和鄰接矩陣關係構建「圖」,利用圖折積神經網路的資訊聚合能力來學習域間關聯和域內資訊,最終在11類人體活動識別上可實現97.37%的分類準確率。Tang等人則是提出了混合折積神經網路架構從雷達的3種時頻圖(短時傅立葉變換、漢寧核減少干擾分佈和平滑偽魏格納分佈譜圖)中提取特徵[14],其中2DCNNs用於提取每種譜圖中的特定特徵,3DCNN則用於提取不同譜圖間的相關性特徵,這兩種特徵融合後可有效提升識別準確率;需要注意的是,這3種時頻譜圖在時序上是對齊的,3DCNN結構更適合提取時序相關性而難以充分捕獲頻域上的不變性,因此這種方法的有效性有待進步評估。

至此,上述所提的深度學習模型多可歸納為有監督學習,有監督學習的詬病在於:一方面,「模型的通用化依賴於大量有標籤資料集」,收集和註釋大量雷達資料集是耗時、耗力的,甚至在某些情況下不可行;另一方面,有監督學習通常基於「訓練域資料和測試域資料共用同一種概率分佈」這一「偽」假設。「偽」:一方面是使用者個體差異、環境差異、目標相對雷達視角等變數均會導致同一類行為上採集的雷達訊號「有偏」;另一方面是資料分佈無法存取,獨立同分布特性無從驗證,因此在傳統的有監督分類任務中,我們往往堅持這種「偽」假設而忽略資料中的差異分佈,試圖讓模型「強制」學習資料域到標籤域的這種對映關係。這種有監督模型雖可實現SOTA的人體活動分類效果,但對於新任務的適應能力卻很弱。有鑑於此,領域自適應方法成為了雷達人體活動識別的新熱點,其通過學習不同域間的共性特徵,將在源域上訓練完成的模型應用於無監督的目標域,能夠有效地解決雷達人體活動資料集上存在的域遷移問題。Lang等人提出了基於特徵的域自適應方法[15],通過CNN從源域和目標域中提取出的域不變特徵、微多普勒特徵、統計特徵等3種特徵來實現源域和目標域的特徵對齊,並用KNN作為分類器實現人體活動識別,這種方法相比TCA、JDA、CORAL等無監督域適應方法具有更優的識別效果,但是所提取的特徵過於「淺層」,難以很好地測量資料集上泛化。為了使源域和目標域特徵分佈在深層適配,Hao等人提出了基於微多普勒的無監督對抗域自適應(ADA)方法[16],這種方法考慮到MOCAP模擬資料集與實測資料集間的差異,引入了域鑑別器與CNN特徵提取器對抗,以使特徵提取器學習到源域和目標域共用的特徵,實驗證明了這種域對抗方法可使模型在具有更好的泛化效能。Li等人在前者基礎上改進了多層域鑑別器[17],這種結構允許源域和目標域能夠在深層次特徵上對齊,以學習到域不變特徵表示,與僅用ADA相比,在5類實測人體活動目標域資料集上效能提升了2.5%。對抗域遷移模組能以無監督形式提取域不變特徵表述,但是卻忽略了源域和目標域間的語意關係,因此,Li等人在先前工作基礎上提出了語意遷移模組聯合對抗域遷移模組的半監督域適應方法[18],通過最小化源域模型訓練輸出的軟標籤和目標域模型輸出的類別概率向量的資訊熵,以實現類相關性從源域至目標域的遷移。Cao等人考慮到不同電磁環境對雷達訊號的影響[19],構建了一種用於跨環境雷達人體活動檢測的環境自適應機制,這種機制利用了基於鄰域聚集和基於聚類的兩種自監督偽標籤生成方法的加權組合,來為目標域資料生成可靠的偽標籤,以提供更強的監督,引導目標特徵提取器的學習、實現不同人體活動在跨環境中的泛化。Yang等人提出了一種雙階段域自適應檢測方法[20],在第一階段中域轉換網路將MOCAP模擬譜圖「翻譯」為偽測量譜圖,第二階段中偽測量譜圖可用於訓練分類器以實現較好的人體活動識別。Chen等人提出了2種域適配網路(JS-DAN和MMD-DAN)來分別學習不同方位採集的微多普勒譜圖中的角度不變性和可區分特徵[21],以消除目標與雷達相對角度變化引起的差異,一定程度上解決了由角度變數引起的域遷移問題。

除了上述以譜圖為輸入主體的方法外,雷達點雲可以重建人體每個部位的散射體,視覺化人體物件的空間物理特徵,以用於人體活動識別。Yu等人提供了一個雷達三維點雲人體活動分類基準資料集[22],其中使用了DBSCAN方法聚類和LSTM時序網路對點雲簇進行分類識別,在4類基準測試集上實現了95%以上的準確率。Young Kim等人使用四級聯MIMO雷達獲取了7種人體活動的高分辨點雲成像[23],並使用深度折積-迴圈神經網路對不同活動的點雲影象序列提取時空特徵以進行分類,這種方法有效解決了目標運動方向與雷達徑向時微多普勒譜圖等特徵提取不明顯的狀況。Li等人提出了一種基於距離-多普勒-時間點雲資料的分層PointNet方法[24],這種方法先將人體後向散射回波通過距離多普勒處理沿時間軸變換為3D點雲集,然後根據檢測點強度資訊對最遠點迭代取樣來聚合特徵,最後通過分層PointNet來學習動態人體運動輪廓以實現人體活動識別,實驗證明這種方法在分類精度、點雲噪聲魯棒性和異常檢測方面具有優異的效能。Gong等人提出了一種適合處理毫米波雷達點雲資料的MMPoint-GNN模型[25],通過利用雷達點雲的空間座標、速度、多普勒頻率、角度、強度和距離等特徵來沿時間軸構建全連線圖集,然後使用具有時間分佈的MMPoint-GNN和雙向LSTM來聚合圖節點的特徵與學習圖前後向關聯資訊,最終實現人體活動分類。點雲的成像質量取決於雷達系統的空間解析度,現有毫米波雷達多以3發4收為主,角解析度較低,難以應用於高精度點雲人體活動識別。相較而言,聯合點雲和目標譜圖實現行為識別是更合適的方案。Huang等人提出了一種雙階段分離多目標微多普勒訊號的方法[26],首先基於點雲實現多目標軌跡跟蹤、利用軌跡差異實現單目標微多普勒訊號的粗分離,其次設計了多工網路來對混疊微多普勒進行精分離,最後實現每個目標的行為識別。Pegoraro等人提出了可線上的多人連續跟蹤與識別系統[27],系統通過在距離-多普勒維或距離-多普勒-角度維上對不同目標點雲進行聚類與簇分離,聯合使用卡爾曼濾波器與DCNN分類器實現了使用者追蹤和識別,其中卡爾曼濾波器輸出會影響使用者分離微多普勒的可靠性,分類器決策資訊會反饋於卡爾曼濾波的軌跡分配。

總結分析,以微多普勒為代表的譜圖是雷達人體活動識別的主流方案,這種方案允許我們在二維層面分析人體不同行為在距離、多普勒、方位等特徵的變化,允許我們根據不同的任務場景、選擇合適的譜圖組合來區分不同人體行為。但譜圖方案存在2個主要的弊端:其一,當目標運動方向與雷達視距正交時,身體不同部位在徑向速度上的投影分量較小,這可能會導致譜圖上的目標散射特徵體現不明顯。其二,多目標場景下不同目標的雷達散射回波訊號會混疊,這可能會導致不同單目標的訊號的解析、分離困難。而3維雷達點雲成像則可彌補這種譜圖方案的缺陷,其可從空間上區分開不同目標的距離、方位,並可捕獲每個目標的物理結構與運動特徵。需要注意的是,毫米波雷達點雲較為稀疏,高精度的成像依賴於雷達天線的空間解析度,對系統成本要求較高。

上述總結源於筆者的畢業設計中期答辯的文獻綜述(截止2022年5月的相關文獻),那麼在這過去的一年中,雷達人體行為識別領域出現了另一種潮流(以BIT-YXP教授團隊的研究[28],[29]為主要代表):稀疏低秩訊號恢復與譜圖的結合(這是一種高階的玩法,但是應該不是第一次出現,在筆者印象中,NTU-JT教授團隊的曾將稀疏重構應用於譜圖-點雲的對映中)。稀疏低秩訊號恢復在雷達線譜估計領域的應用(如目標檢測CFAR、目標定位DOA等)相對較多,應用於微多普勒等特徵域譜圖確實會有點給人以煥新的感覺,但是其實這裡需要思考一個問題是:如何將基於稀疏重構(或空間分解)思想分層從特徵域譜圖中所解析出的噪聲訊號、背景訊號、目標特徵訊號和下游任務的評估解耦是值得令人深思的地方?為了進一步理解這句話,我將其抽象為以下幾層:

1、稀疏重構方法能夠有效地將目標特徵域譜圖理想地分解為噪聲空間、目標特徵空間、背景空間,甚至干擾空間嗎?不同空間不存在耦合嗎?噪聲/干擾/背景空間對目標特徵的識別一定是負作用嗎?

2、不稀疏重構的譜圖作為網路輸入與稀疏重構的訊號譜圖作為網路輸入對最終模型的泛化效能影響會顯著嗎?

3、將稀疏訊號重構和下游任務分離處理恐難以嚴格地判定方法的可行性,構建訊號輸入到下游識別的端到端任務仍是關鍵所在。

4、此外,稀疏重構在一定程度上能夠緩解背景環境對目標特徵訊號的影響,但並沒有完全上去解決當前雷達人體行為識別領域面臨的多特徵域泛化難點(角度、環境、使用者差異等協變數偏移引起的泛化效能下降問題),我認為這是當前雷達人體行為識別領域應重點著力去思考解決的地方,甚至是能否建立一套統一的框架去處理各種情況。

以上觀點並不意味著稀疏重構對雷達人體行為識別領域的無意義性,新的學科融合必然會帶來新的思考;在這裡,我想提供一點新的思考:結合稀疏重構訊號模型和學習驅動正規化來構建深度展開網路,並在深度展開網路的基礎上增加下游任務如識別模型,開展多工處理或許會是一個新的海洋。

水上行為識別資料集

靜靜等待筆者的碼字----->

TSFNet

靜靜等待筆者的碼字----->

SIMFNet

靜靜等待筆者的碼字----->

參考文獻

[1] Zhang Z, Zhang R, Sheng W, et al. Feature extraction and classification of human motions with LFMCW radar[C]. 2016 IEEE International Workshop on Electromagnetics: Applications and Student Innovation Competition (iWEM). IEEE, 2016: 1-3.

[2] Jokanovic B, Amin M, Ahmad F. Radar fall motion detection using deep learning[C]. 2016 IEEE radar conference (RadarConf). IEEE, 2016: 1-6.

[3] Li J, Chen X, Yu G, et al. High-precision human activity classification via radar micro-doppler signatures based on deep neural network[C]. IET International Radar Conference (IET IRC 2020). IET, 2020, 2020: 1124-1129.

[4] He Y, Yang Y, Lang Y, et al. Deep learning based human activity classification in radar micro-Doppler image[C]. 2018 15th European Radar Conference (EuRAD). IEEE, 2018: 230-233.

[5] Du H, Jin T, Song Y, et al. Efficient human activity classification via sparsity‐driven transfer learning[J]. IET Radar, Sonar & Navigation, 2019, 13(10): 1741-1746.

[6] Seyfioglu M S, Erol B, Gurbuz S Z, et al. DNN transfer learning from diversified micro-Doppler for motion classification[J]. IEEE Transactions on Aerospace and Electronic Systems, 2018, 55(5): 2164-2180.

[7] Seyfioğlu M S, Gürbüz S Z. Deep neural network initialization methods for micro-Doppler classification with low training sample support[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(12): 2462-2466.

[8] Shrestha A, Li H, Le Kernec J, et al. Continuous human activity classification from FMCW radar with Bi-LSTM networks[J]. IEEE Sensors Journal, 2020, 20(22): 13607-13619.

[9] Wang M, Zhang Y D, Cui G. Human motion recognition exploiting radar with stacked recurrent neural network[J]. Digital Signal Processing, 2019, 87: 125-131.

[10] Chen Z, Li G. Human activity classification with neural network using radar micro-doppler and range signatures[J]. 2021.

[11] Zhu J, Chen H, Ye W. A hybrid CNN–LSTM network for the classification of human activities based on micro-Doppler radar[J]. IEEE Access, 2020, 8: 24713-24720.

[12] Ding W, Guo X, Wang G. Radar-based human activity recognition using hybrid neural network model with multidomain fusion[J]. IEEE Transactions on Aerospace and Electronic Systems, 2021, 57(5): 2889-2898.

[13] Wang X, Guo S, Chen J, et al. GCN-Enhanced Multi-domain Fusion Network for Through-wall Human Activity Recognition[J]. IEEE Geoscience and Remote Sensing Letters, 2022.

[14] Tang L, Jia Y, Qian Y, et al. Human Activity Recognition Based on Mixed CNN With Radar Multi-Spectrogram[J]. IEEE Sensors Journal, 2021, 21(22): 25950-25962.

[15] Lang Y, Wang Q, Yang Y, et al. Unsupervised domain adaptation for micro-Doppler human motion classification via feature fusion[J]. IEEE Geoscience and Remote Sensing Letters, 2018, 16(3): 392-396.

[16] Du H, Jin T, Song Y, et al. Unsupervised adversarial domain adaptation for micro-Doppler based human activity classification[J]. IEEE geoscience and remote sensing letters, 2019, 17(1): 62-66.

[17] Li X, Jing X, He Y. Unsupervised domain adaptation for human activity recognition in radar[C]. 2020 IEEE Radar Conference (RadarConf20). IEEE, 2020: 1-5.

[18] Li X, He Y, Fioranelli F, et al. Semisupervised human activity recognition with radar micro-Doppler signatures[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 60: 1-12.

[19] Cao Z, Li Z, Guo X, et al. Towards Cross-Environment Human Activity Recognition Based on Radar Without Source Data[J]. IEEE Transactions on Vehicular Technology, 2021, 70(11): 11843-11854.

[20] Yang Y, Zhang Y, Ji H, et al. Radar-Based Human Activity Recognition Under the Limited Measurement Data Support Using Domain Translation[J]. IEEE Signal Processing Letters, 2022.

[21] Chen Q, Liu Y, Fioranelli F, et al. Eliminate aspect angle variations for human activity recognition using unsupervised deep adaptation network[C]. 2019 IEEE Radar Conference (RadarConf). IEEE, 2019: 1-6.

[22] Yu Z, Taha A, Taylor W, et al. A Radar-based Human Activity Recognition Using a Novel 3D point cloud classifier[J]. IEEE Sensors Journal, 2022.

[23] Kim Y, Alnujaim I, Oh D. Human activity classification based on point clouds measured by millimeter wave MIMO radar with deep recurrent neural networks[J]. IEEE Sensors Journal, 2021, 21(12): 13522-13529.

[24] Li M, Chen T, Du H. Human behavior recognition using range-velocity-time points[J]. IEEE Access, 2020, 8: 37914-37925.

[25] Gong P, Wang C, Zhang L. Mmpoint-GNN: graph neural network with dynamic edges for human activity recognition through a millimeter-wave radar[C]. 2021 International Joint Conference on Neural Networks (IJCNN). IEEE, 2021: 1-7.

[26] Huang X, Ding J, Liang D, et al. Multi-person recognition using separated micro-Doppler signatures[J]. IEEE Sensors Journal, 2020, 20(12): 6605-6611.

[27] Pegoraro J, Meneghello F, Rossi M. Multiperson continuous tracking and identification from mm-wave micro-Doppler signatures[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 59(4): 2994-3009.

[28] X. Qu, W. Gao, H. Meng, Y. Zhao and X. Yang, "Indoor Human Behavior Recognition Method Based on Wavelet Scattering Network and Conditional Random Field Model," in IEEE Transactions on Geoscience and Remote Sensing, vol. 61, pp. 1-15, 2023, Art no. 5104815, doi: 10.1109/TGRS.2023.3276023.

[29] W. Gao, X. Yang, X. Qu and T. Lan, "TWR-MCAE: A Data Augmentation Method for Through-the-Wall Radar Human Motion Recognition," in IEEE Transactions on Geoscience and Remote Sensing, vol. 60, pp. 1-17, 2022, Art no. 5118617, doi: 10.1109/TGRS.2022.3213748.