Tensorflow搭建一個神經網路

2021-05-15 05:00:08

一、Tensorlow結構

import tensorflow as tf

import numpy as np

#建立資料

x_data = np.random.rand(100).astype(np.float32)

y_data = x_data*0.1+0.3

#建立一個 tensorlow 結構

weights = tf.Variable(tf.random_uniform([1], -1.0, 1.0))#一維,範圍[-1,1]

biases = tf.Variable(tf.zeros([1]))

y = weights*x_data + biases

loss = tf.reduce_mean(tf.square(y - y_data))#均方差函數

#建立優化器,減少誤差,提高引數準確度,每次迭代都會優化

optimizer = tf.train.GradientDescentOptimizer(0.5)#學習率為0.5(<1)

train = optimizer.minimize(loss)#最小化損失函數

#初始化不變數

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

#train

for step in range(201):

sess.run(train)

if step % 20 == 0:

print(step, sess.run(weights), sess.run(biases))二、session的使用

import tensorflow as tf

matrix1 = tf.constant([[3, 3]])

matrix2 = tf.constant([[2], [2]])

product = tf.matmul(matrix1, matrix2)

#method1

sess = tf.Session()

result2 = sess.run(product)

print(result2)

#method2

# with tf.Session() as sess:

# result2 = sess.run(product)

# print(result2)

三、Variable的使用

import tensorflow as tf

state = tf.Variable(0, name = 'counter')#變數初始化

# print(state.name)

one = tf.constant(1)

new_value = tf.add(state, one)

#將state用new_value代替

updata = tf.assign(state, new_value)

#變數啟用

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

for _ in range(3):

sess.run(updata)

print(sess.run(state))四、placeholder的使用

#給定type,tf大部分只能處理float32資料

input1 = tf.placeholder(tf.float32)

input2 = tf.placeholder(tf.float32)

output = tf.multiply(input1, input2)

with tf.Session() as sess:

print(sess.run(output, feed_dict={input1:[7.], input2:[2.]}))

五、啟用函數

六、新增層

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

def add_layer(inputs, in_size, out_size, activation_function = None):

Weights = tf.Variable(tf.random_normal([in_size, out_size]))#正態分佈

biases = tf.Variable(tf.zeros([1, out_size])+0.1) #1行,out_size列,初始值不推薦為0,所以加上0.1

Wx_plus_b = tf.matmul(inputs, Weights) + biases #Weights*x+b的初始化值,也是未啟用的值

#啟用

if activation_function is None:

#如果沒有設定啟用函數,,則直接把當前訊號原封不動的傳遞出去

outputs = Wx_plus_b

else:

#如果設定了啟用函數,則由此啟用函數對訊號進行傳遞或抑制

outputs = activation_function(Wx_plus_b)

return outputs

七、建立一個神經網路

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

def add_layer(inputs, in_size, out_size, activation_function = None):

Weights = tf.Variable(tf.random_normal([in_size, out_size]))#正態分佈

biases = tf.Variable(tf.zeros([1, out_size])+0.1) #1行,out_size列,初始值不推薦為0,所以加上0.1

Wx_plus_b = tf.matmul(inputs, Weights) + biases #Weights*x+b的初始化值,也是未啟用的值

#啟用

if activation_function is None:

#如果沒有設定啟用函數,,則直接把當前訊號原封不動的傳遞出去

outputs = Wx_plus_b

else:

#如果設定了啟用函數,則由此啟用函數對訊號進行傳遞或抑制

outputs = activation_function(Wx_plus_b)

return outputs

"""定義資料形式"""

#建立一列(相當於只有一個屬性值),(-1,1)之間,有300個單位,後面是維度,x_data是有300行

x_data = np.linspace(-1, 1, 300)[:, np.newaxis]#np.linspace在指定間隔內返回均勻間隔數位

#加入噪聲,均值為0,方差為0.05,形狀和x_data一樣

noise = np.random.normal(0, 0.05, x_data.shape)

#定義y的函數為二次曲線函數,同時增加一些噪聲資料

y_data = np.square(x_data) - 0.5 + noise

#定義輸入值,輸入結構的輸入行數不固定,但列就是1列的值

xs = tf.placeholder(tf.float32, [None, 1])

ys = tf.placeholder(tf.float32, [None, 1])

"""建立網路"""

#定義隱藏層,輸入為xs,輸入size為1列,因為x_data只有一個屬性值,輸出size假定有10個神經元的隱藏層,啟用函數relu

l1 = add_layer(xs, 1, 10, activation_function=tf.nn.relu)

#定義輸出層,輸出為l1輸入size為10列,也就是l1的列數,輸出size為1,這裡的輸出類似y_data,因此為1列

prediction = add_layer(l1, 10, 1,activation_function=None)

"""預測"""

#定義損失函數為差值平方和的平均值

loss = tf.reduce_mean(tf.reduce_sum(tf.square(ys-prediction),reduction_indices=[1]))

"""訓練"""

#進行逐步優化的梯度下降優化器,學習率為0.1,以最小化損失函數進行優化

train_step = tf.train.GradientDescentOptimizer(0.1).minimize(loss)

#初始化模型所有引數

init = tf.global_variables_initializer()

#視覺化

with tf.Session() as sess:

sess.run(init)

for i in range(1000):#學習1000次

sess.run(train_step, feed_dict={xs:x_data, ys:y_data})

if i%50==0:

print(sess.run(loss, feed_dict={xs:x_data, ys:y_data}))

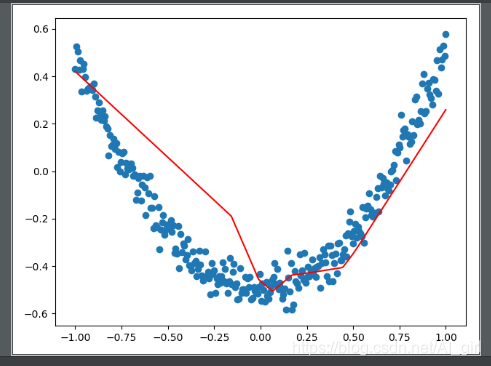

八、視覺化

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

def add_layer(inputs, in_size, out_size, activation_function = None):

Weights = tf.Variable(tf.random_normal([in_size, out_size]))#正態分佈

biases = tf.Variable(tf.zeros([1, out_size])+0.1) #1行,out_size列,初始值不推薦為0,所以加上0.1

Wx_plus_b = tf.matmul(inputs, Weights) + biases #Weights*x+b的初始化值,也是未啟用的值

#啟用

if activation_function is None:

#如果沒有設定啟用函數,,則直接把當前訊號原封不動的傳遞出去

outputs = Wx_plus_b

else:

#如果設定了啟用函數,則由此啟用函數對訊號進行傳遞或抑制

outputs = activation_function(Wx_plus_b)

return outputs

"""定義資料形式"""

#建立一列(相當於只有一個屬性值),(-1,1)之間,有300個單位,後面是維度,x_data是有300行

x_data = np.linspace(-1, 1, 300)[:, np.newaxis]#np.linspace在指定間隔內返回均勻間隔數位

#加入噪聲,均值為0,方差為0.05,形狀和x_data一樣

noise = np.random.normal(0, 0.05, x_data.shape)

#定義y的函數為二次曲線函數,同時增加一些噪聲資料

y_data = np.square(x_data) - 0.5 + noise

#定義輸入值,輸入結構的輸入行數不固定,但列就是1列的值

xs = tf.placeholder(tf.float32, [None, 1])

ys = tf.placeholder(tf.float32, [None, 1])

"""建立網路"""

#定義隱藏層,輸入為xs,輸入size為1列,因為x_data只有一個屬性值,輸出size假定有10個神經元的隱藏層,啟用函數relu

l1 = add_layer(xs, 1, 10, activation_function=tf.nn.relu)

#定義輸出層,輸出為l1輸入size為10列,也就是l1的列數,輸出size為1,這裡的輸出類似y_data,因此為1列

prediction = add_layer(l1, 10, 1,activation_function=None)

"""預測"""

#定義損失函數為差值平方和的平均值

loss = tf.reduce_mean(tf.reduce_sum(tf.square(ys-prediction),reduction_indices=[1]))

"""訓練"""

#進行逐步優化的梯度下降優化器,學習率為0.1,以最小化損失函數進行優化

train_step = tf.train.GradientDescentOptimizer(0.1).minimize(loss)

#初始化模型所有引數

init = tf.global_variables_initializer()

#視覺化

with tf.Session() as sess:

sess.run(init)

fig = plt.figure()#先生成一個圖片框

#連續性畫圖

ax = fig.add_subplot(1, 1, 1)#編號為1,1,1

ax.scatter(x_data, y_data)#畫散點圖

#不暫停

plt.ion()#開啟互交模式

# plt.show()

#plt.show繪製一次就暫停了

for i in range(1000):#學習1000次

sess.run(train_step, feed_dict={xs:x_data, ys:y_data})

if i%50==0:

try:

#畫出一條後,抹除掉,去除第一個線段,但是隻有一個相當於抹除當前線段

ax.lines.remove(lines[0])

except Exception:

pass

prediction_value = sess.run(prediction, feed_dict={xs:x_data})

lines = ax.plot(x_data,prediction_value,'r-',lw=5)#lw線寬

#暫停

plt.pause(0.5)

視覺化結果: